Fortgeschrittene KI: ComfyUI

OpenShot kann eine Verbindung zu einem lokalen ComfyUI-Server herstellen und KI-Workflows über die Kontextmenüs „Projektdateien“ und „Zeitleiste“ ausführen. Auf dieser Seite wird erläutert, was diese Tools sind, welche Hardware sie benötigen und wo sich die integrierten Workflow-Vorlagen befinden.

Warnung

KI-Funktionen in OpenShot sind experimentell und erfordern eine High-End-Workstation.

Diese Werkzeuge werden für Laptops, Mittelklasse-Desktops oder Budget-Systeme nicht empfohlen.

Sie müssen einen lokalen ComfyUI Server betreiben.

Sie sollten mit Modell-Downloads, Einrichtung und Fehlerbehebung bei Workflows rechnen.

Mindestempfohlene Hardware

Komponente |

Empfehlung |

|---|---|

GPU |

NVIDIA 5070 12 GB oder besser (16–24 GB VRAM dringend bevorzugt) |

CPU |

Ryzen 9 5900er Klasse CPU (oder gleichwertige Multi-Core-CPU mit hoher Taktfrequenz) |

Systemspeicher |

64GB RAM oder mehr |

Speicher |

200GB freier Speicherplatz für Modelle, Cache und erzeugte Ausgaben |

Erfahrung |

Vertraut mit ComfyUI-Diagrammen, Modellen und Knotenabhängigkeiten |

Wenn Ihr System unter diesen Anforderungen liegt, werden Aufgaben hängen bleiben, fehlschlagen und instabile Ergebnisse liefern. Wenn Ihre GPU 8GB oder weniger VRAM hat, wird der Speicher bei der Ausführung dieser Modelle erschöpft sein.

Installation und Einrichtung

Verwenden Sie diesen Schnell-Einrichtungsweg, bevor Sie einen KI-Workflow in OpenShot ausprobieren:

Installieren Sie ComfyUI und bestätigen Sie, dass es korrekt startet.

Installieren Sie die erforderlichen benutzerdefinierten Knoten (unten aufgeführt).

Laden Sie die erforderlichen Modell-Dateien (unten aufgeführt) in die entsprechenden Modellordner herunter.

Starten Sie ComfyUI, öffnen Sie dann Edit->Preferences->Advanced und legen Sie ComfyUI URL fest.

Klicken Sie auf Überprüfen, um zu bestätigen, dass OpenShot den Server erreichen kann.

Für eine vollständige Schritt-für-Schritt-Anleitung zur Servereinrichtung siehe das OpenShot-Wiki: ComfyUI: Advanced AI Setup Guide.

Für vollständige Installationsdetails von ComfyUI siehe das offizielle Repository: ComfyUI auf GitHub.

Erforderliche benutzerdefinierte Knoten

Erforderliche Modelle / Dateien

ComfyUI/models/diffusion_models/wan2.1_vace_1.3B_fp16.safetensorsComfyUI/custom_nodes/ComfyUI-Frame-Interpolation/ckpts/rife/rife47.pthComfyUI/models/checkpoints/sd_xl_base_1.0.safetensorsComfyUI/models/checkpoints/sd_xl_refiner_1.0.safetensorsComfyUI/models/checkpoints/stable-audio-open-1.0.safetensorsComfyUI/models/clip_vision/clip_vision_g.safetensorsComfyUI/models/diffusion_models/wan2.2_ti2v_5B_fp16.safetensorsComfyUI/models/grounding-dino/groundingdino_swint_ogc.pthComfyUI/models/sam2/sam2.1_hiera_base_plus.ptComfyUI/models/sam2/sam2.1_hiera_small-fp16.safetensorsComfyUI/models/sam2/sam2.1_hiera_small.ptComfyUI/models/sam2/sam2.1_hiera_tiny-fp16.safetensorsComfyUI/models/sam2/sam2.1_hiera_tiny.ptComfyUI/models/sam2/sam2_hiera_small.ptComfyUI/models/stt/whisper/large-v3.ptComfyUI/models/stt/whisper/medium.ptComfyUI/models/text_encoders/t5-base.safetensorsComfyUI/models/text_encoders/umt5_xxl_fp8_e4m3fn_scaled.safetensorsComfyUI/models/TTS/Ace-Step1.5/acestep-v15-turbo/silence_latent.ptComfyUI/models/upscale_models/RealESRGAN_x4plus.safetensorsComfyUI/models/vae/wan_2.1_vae.safetensorsComfyUI/models/vae/wan2.2_vae.safetensorsComfyUI/models/VLM/transnetv2-pytorch-weights/transnetv2-pytorch-weights.pth

Was Benutzer in OpenShot sehen

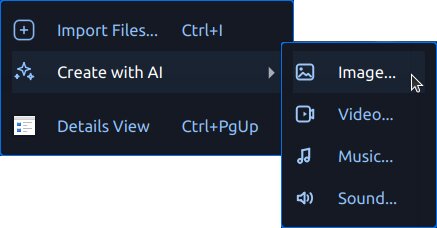

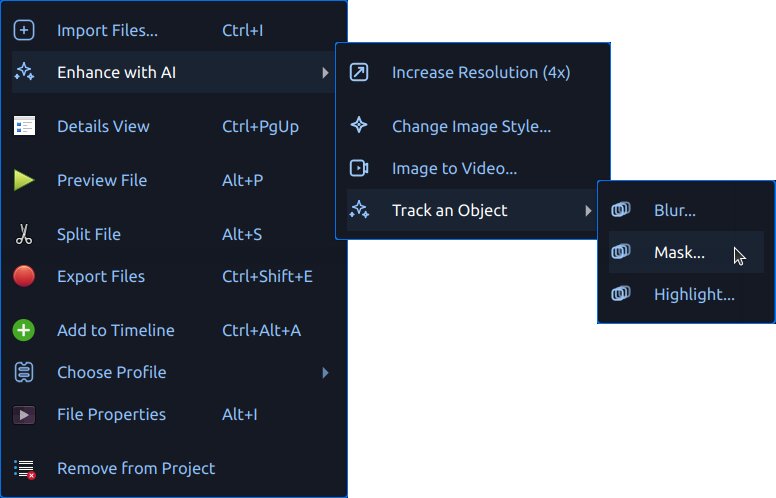

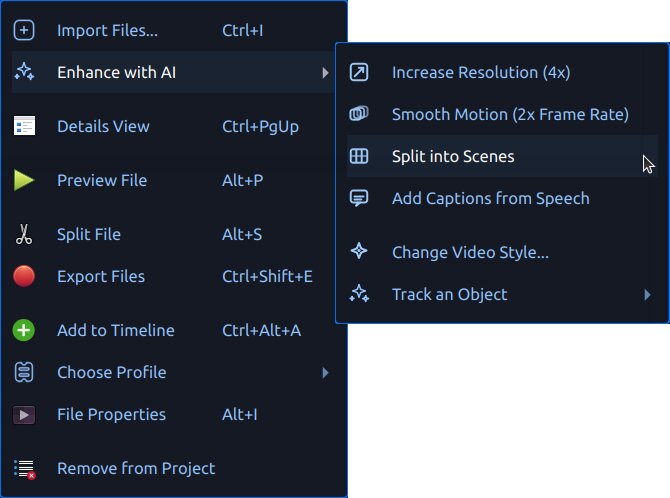

Wenn ComfyUI verfügbar ist, zeigt OpenShot KI-Werkzeuge in Kontextmenüs an:

Mit KI erstellen zum Erstellen neuer Assets

Mit KI verbessern (Bilder) zur Verarbeitung von Bild-Assets

Mit KI verbessern (Videos) zur Verarbeitung von Video-Assets

Generierte Dateien werden mit Fortschrittstext und Warteschlangenabzeichen zu Projektdateien hinzugefügt. Ausgaben werden unter .openshot_qt/comfyui-output/ gespeichert.

Das Starten eines neuen Projekts oder das Öffnen eines bestehenden Projekts löscht die temporären .openshot_qt AI-Arbeitsordner, sodass Sie mit einer sauberen Basis beginnen. Ihre gespeicherten Projekte bleiben unberührt, und alle zuvor in einen PROJECTNAME_Assets-Ordner kopierten Assets bleiben im Verzeichnis dieses Projekts.

Wenn ComfyUI nicht verfügbar ist, deaktiviert OpenShot die AI-Menüs. Konfigurieren Sie die Server-URL in Edit->Preferences->Advanced und verwenden Sie dann die Schaltfläche Check, um die Konnektivität zu testen.

Arbeitsablaufvorlagen

OpenShot liest integrierte Vorlagen von comfyui/. Außerdem werden benutzerdefinierte Benutzervorlagen von ~/.openshot_qt/comfyui/ geladen.

So fügen Sie Ihren eigenen Arbeitsablauf hinzu:

Öffnen Sie in ComfyUI die Arbeitsablauf-Registerkarte, die Sie verwenden möchten.

Wählen Sie Exportieren (API), um den Arbeitsablauf als

*.json-Datei zu speichern.Kopieren Sie diese JSON-Datei in

~/.openshot_qt/comfyui/.Starten Sie OpenShot neu oder öffnen Sie das Projekt bei Bedarf erneut.

OpenShot lädt den Arbeitsablauf automatisch und zeigt ihn im entsprechenden AI-Menü an. Wenn Sie ihn in OpenShot auslösen, wird die ausgewählte Quelldatei in den Arbeitsablauf übergeben, und die Ausgabe des letzten Ausgabeknotens des Arbeitsablaufs wird zurück in Projektdateien importiert.

OpenShot schreibt außerdem eine .openshot_qt/comfyui/debug.json-Datei für fortgeschrittene Benutzer, die die genaue an ComfyUI gesendete Anfrage überprüfen möchten.

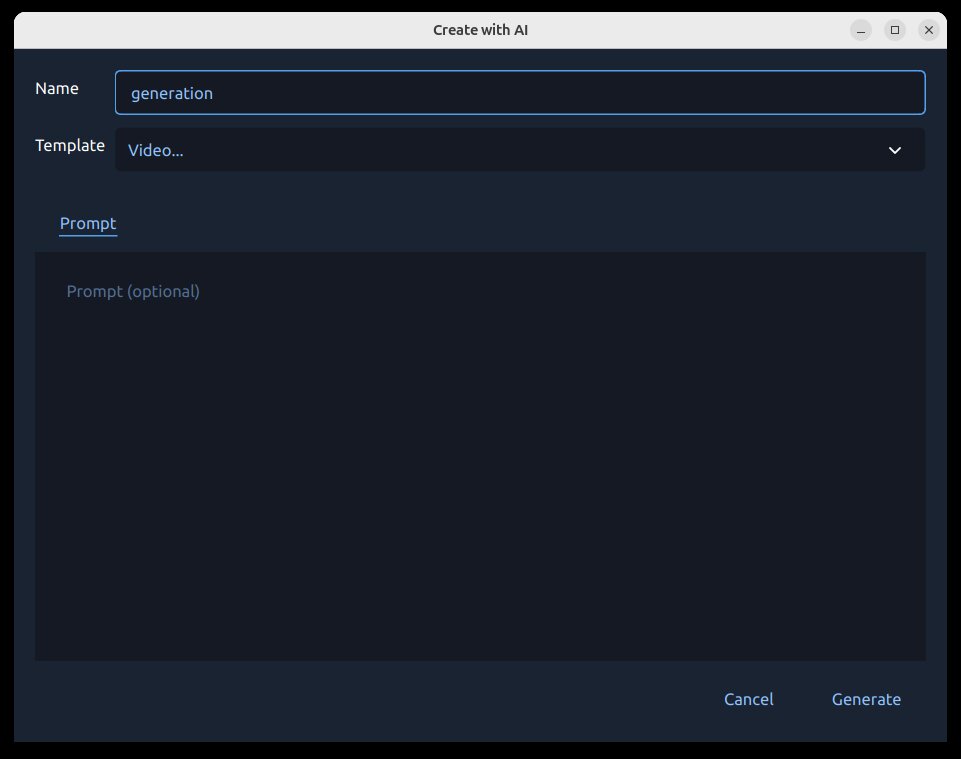

AI-Aktionsdialog

Sowohl Mit AI erstellen als auch Mit AI verbessern öffnen denselben Generierungsdialog.

Warum dieser Dialog wichtig ist:

Er hält alle AI-Eingaben an einem Ort.

Er überprüft erforderliche Felder, bevor der Auftrag in die Warteschlange gestellt wird.

Er ermöglicht es Ihnen, Tracking-Aufforderungen vor aufwändigen Durchläufen einzurichten.

Was Sie im Dialog tun können:

Wählen Sie den Arbeitsablauf/die Aktion.

Geben Sie den Eingabetext ein.

Vorschau der ausgewählten Quelldatei (für Verbesserungs-Arbeitsabläufe).

Legen Sie den Ausgabename für generierte Medien fest.

Wähle ein Referenzbild im Reference-Tab für Arbeitsabläufe, die eines benötigen.

Geben Sie Tracking-Punkte/-Rechtecke für Tracking-Arbeitsabläufe an.

Starten Sie den Auftrag mit Generieren oder schließen Sie mit Abbrechen.

Tracking (Maske, Weichzeichnen, Hervorheben)

Tracking-Arbeitsabläufe (Weichzeichnen…, Hervorheben…, Maske…) verwenden einen Bereichsbildschirm, auf dem Sie markieren, was einbezogen und was ignoriert werden soll.

Warum das wichtig ist

Tracking hilft dabei, dass Ihr Effekt über die Zeit an einem sich bewegenden Objekt haftet. Zum Beispiel können Sie ein Gesicht weichzeichnen, einen Spieler hervorheben oder eine saubere Maske erzeugen, die dasselbe Objekt über viele Frames verfolgt.

Tracking-Symbole

Symbol / Marker |

Bedeutung |

|---|---|

Blauer Punkt |

Positive Tracking-Koordinate (Vordergrund/Subjekt-Stützpunkt). |

Roter Punkt |

Negative Tracking-Koordinate (Hintergrund/Ausschluss-Stützpunkt). |

Blaues Rechteck |

Positiver Bereichsstützpunkt (breiter Subjekt-Hinweis). |

Rotes Rechteck |

Negativer Bereichsstützpunkt (breiter Ausschluss-Hinweis). |

Symbol löschen |

Alle aktuellen Tracking-Stützpunkte (Punkte/Rechtecke) löschen und neu beginnen. |

Wie Tracking funktioniert

OpenShot sendet Ihre positiven und negativen Marker als Stützpunktkoordinaten an das Tracking-Modell, das eine Maske für das Subjekt erstellt und diese dann über die Zeit verfolgt. Bessere Stützpunkte erzeugen in der Regel sauberere Masken und weniger Drift. [sam2]

Wie man es benutzt

Wählen Sie einen Frame, in dem das Subjekt klar sichtbar ist.

Beginnen Sie mit einem blauen Punkt auf dem Subjekt.

Fügen Sie rote Punkte nur bei Bedarf auf dem nahegelegenen Hintergrund hinzu.

Fügen Sie Rechtecke hinzu, wenn Sie eine schnellere breite Auswahl benötigen.

Wiederholen Sie dies bei weiteren Frames, wenn sich Bewegung/Form ändert.

Anpassung über die Zeit (Frame-Schieberegler):

Bewegen Sie den Frame-Schieberegler zu verschiedenen Zeitpunkten im Clip.

Fügen Sie Punkte/Rechtecke hinzu oder passen Sie sie an Frames an, bei denen das Tracking zu driften beginnt.

Verwenden Sie zusätzliche Stützpunkte nur dort, wo sie benötigt werden, insbesondere bei Verdeckungen, schneller Bewegung oder großen Formänderungen.

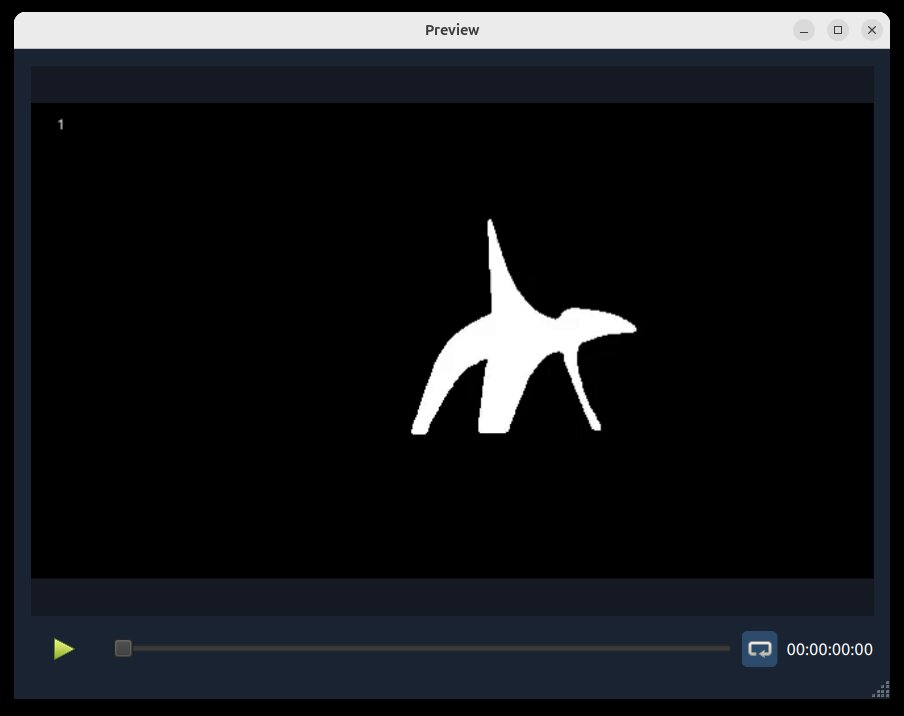

Masken-Vorschau-Ausgabe (aus diesem Tracking-Prozess):

Beste Vorgehensweisen

Verwenden Sie zuerst einen kurzen Testclip.

Beginnen Sie einfach: Ein einzelner blauer Punkt ist oft ausreichend.

Fügen Sie nur dort weitere Punkte hinzu, wo das Tracking versagt.

Fügen Sie bei Bedarf eine differenziertere Menge positiver/negativer Punkte und Rechtecke hinzu.

Halten Sie positive und negative Punkte klar getrennt.

Wenn das Tracking unübersichtlich wird, verwenden Sie das Löschsymbol und starten Sie mit saubereren Startpunkten neu.

SAM2 (Segment Anything Model 2) Projekt: facebookresearch/sam2

Auftragswarteschlange, Fortschritt und Abbrechen

Nachdem Sie auf Generieren klicken, wird die Anfrage in die Warteschlange gestellt und in OpenShots KI-Auftragswarteschlange ausgeführt.

Der Fortschritt wird in Projektdateien (Abzeichen und Statusanzeige) angezeigt.

Abgeschlossene Ausgaben werden zurück in Projektdateien importiert.

Aktive Jobs können abgebrochen werden, indem Sie mit der rechten Maustaste auf die generierte Projektdatei mit dem Fortschrittsbalken klicken und Cancel Job auswählen.

Ausgaben werden unter

.openshot_qt/comfyui-output/gespeichert.

Eingebaute JSON-Arbeitsabläufe

Die folgenden Abschnitte sind direkt den integrierten JSON-Vorlagen in comfyui/ zugeordnet. In jedem Unterabschnitt wird beschrieben, warum Sie es verwenden können, wie es ausgeführt wird und welche wichtigen Details es gibt.

Mit KI erstellen

Bild… (txt2img-basic)

Warum: Erzeugen Sie Standbilder aus einem Textprompt.

Wie: Wählen Sie Mit KI erstellen -> Bild…, geben Sie einen Prompt ein und generieren Sie dann.

Details: Verwendet

comfyui/txt2img-basic.jsonmitsd_xl_base_1.0.safetensors.

Video… (txt2video-svd)

Warum: Erzeugen Sie kurze Videoclips aus Text.

Wie: Wählen Sie Mit KI erstellen -> Video…, geben Sie einen Prompt ein und generieren Sie dann.

Details: Verwendet

comfyui/txt2video-svd.jsonmit WAN-Videogenerierungsmodellen.

Ton… (txt2audio-stable-open)

Warum: Erzeugen Sie nicht-musikalische Audiodateien aus Textprompts.

Wie: Wählen Sie Mit KI erstellen -> Ton…, geben Sie einen Prompt ein und generieren Sie dann.

Details: Verwendet

comfyui/txt2audio-stable-open.jsonmit Stable Audio Open-Modellen.

Musik… (txt2music-ace-step)

Warum: Erzeugen Sie Musik aus Stil/Tags (und optionalen Texten).

Wie: Wählen Sie Mit KI erstellen -> Musik…, geben Sie einen Prompttext ein und generieren Sie dann.

Details: Verwendet

comfyui/txt2music-ace-step.jsonmit einem Ace-Step 1.5-Prüfpunkt.

Mit KI verbessern

Bildstil ändern… (img2img-basic)

Warum: Ändern Sie den Stil eines vorhandenen Bildes, während die ursprüngliche Komposition erhalten bleibt.

Wie: Wählen Sie Mit KI verbessern bei einem Bild, geben Sie einen Stil-Prompt ein und generieren Sie dann.

Details: Verwendet

comfyui/img2img-basic.jsonmitsd_xl_base_1.0.safetensors.

Tiefe (image-extract-depth)

Warum: Exportiere eine Graustufen-Tiefenkarte aus einem Quellbild.

Wie: Wähle bei einem Bild Mit KI verbessern -> Extrahieren -> Tiefe und dann Generieren.

Details: Verwendet

comfyui/image-extract-depth.jsonmitDepthAnythingV2Preprocessor.

Linien (image-extract-lines)

Warum: Exportiere eine Linienkarte aus einem Quellbild.

Wie: Wähle bei einem Bild Mit KI verbessern -> Extrahieren -> Linien und dann Generieren.

Details: Verwendet

comfyui/image-extract-lines.jsonmitLineArtPreprocessor.

Bild zu Video… (img2video-wan)

Warum: Verwandeln Sie ein Standbild in eine generierte Videoaufnahme.

Wie: Wählen Sie Mit KI verbessern bei einem Bild, geben Sie eine Prompt-Anleitung ein und generieren Sie dann.

Details: Verwendet

comfyui/img2video-wan.jsonmit WAN 2.2 Bild-zu-Video-Modellen.

Videostil ändern… (video2video-basic)

Warum: Wenden Sie einen neuen visuellen Stil auf ein Quellvideo an.

Wie: Wähle bei einem Video Mit KI verbessern, gib eine Stilvorgabe ein, wähle ein Referenzbild im Reference-Tab und generiere dann.

Details: Verwendet

comfyui/video2video-basic.jsonmit WAN VACE Video-zu-Video-Knoten, einem erforderlichen Referenzbild, gemischterDepthAnythingV2Preprocessor-Tiefe plus Canny-Kantenerkennung und den Modellenwan2.1_vace_1.3B_fp16.safetensors,wan_2.1_vae.safetensorsundumt5_xxl_fp8_e4m3fn_scaled.safetensors.

Tiefe (video-extract-depth)

Warum: Exportiere eine Graustufen-Tiefenkarte eines Quellvideos.

Wie: Wähle bei einem Video Mit KI verbessern -> Extrahieren -> Tiefe und dann Generieren.

Details: Verwendet

comfyui/video-extract-depth.jsonmitDepthAnythingV2Preprocessorund erhält die ursprüngliche Bildrate.

Linien (video-extract-lines)

Warum: Exportiere eine Linienkarte eines Quellvideos.

Wie: Wähle bei einem Video Mit KI verbessern -> Extrahieren -> Linien und dann Generieren.

Details: Verwendet

comfyui/video-extract-lines.jsonmitLineArtPreprocessorund erhält die ursprüngliche Bildrate.

Auflösung erhöhen (Bild) (upscale-realesrgan-x4)

Warum: Skalieren Sie Bilder mit niedriger Auflösung hoch.

Wie: Wählen Sie Mit KI verbessern bei einem Bild, wählen Sie Auflösung erhöhen und generieren Sie dann.

Details: Verwendet

comfyui/upscale-realesrgan-x4.jsonmitRealESRGAN_x4plus.safetensors.

Auflösung erhöhen (Video) (video-upscale-gan)

Warum: Skalieren Sie Videobilder hoch für mehr sichtbare Details.

Wie: Wählen Sie Mit KI verbessern bei einem Video, wählen Sie Auflösung erhöhen und generieren Sie dann.

Details: Verwendet

comfyui/video-upscale-gan.jsonmitRealESRGAN_x4plus.safetensors.

Sanfte Bewegung (2x Bildrate) (video-frame-interpolation-rife2x)

Warum: Erhöhen Sie die Bildrate für eine flüssigere wahrgenommene Bewegung.

Wie: Wählen Sie Mit KI verbessern bei einem Video, wählen Sie sanfte Bewegung und generieren Sie dann.

Details: Verwendet

comfyui/video-frame-interpolation-rife2x.jsonmitrife47.pth.

In Szenen aufteilen (video-segment-scenes-transnet)

Warum: Erkennen Sie automatisch Szenenwechsel und teilen Sie lange Clips in Segmente auf.

Wie: Wählen Sie Mit KI verbessern bei einem Video, wählen Sie Szenentrennung und generieren Sie dann.

Details: Verwendet

comfyui/video-segment-scenes-transnet.jsonmit TransNetV2.

Untertitel aus Sprache hinzufügen (video-whisper-srt)

Warum: Sprache in Untertitel-/Caption-Dateien transkribieren.

Wie: Wählen Sie bei einem Video Mit KI verbessern, dann Untertitel auswählen und generieren.

Details: Verwendet

comfyui/video-whisper-srt.jsonund erstellt eine SRT-Ausgabe.

Tracking-Workflows (SAM2)

Diese Workflows verwenden denselben Bereichs-/Tracking-Eingabefluss und sind im Tracking-Kontextmenü gruppiert.

Weichzeichnen… (Bild) (image-blur-anything-sam2)

Warum: Ausgewählte Motivbereiche in einem Standbild weichzeichnen.

Wie: Punkte/Rechtecke für das Motiv auswählen, dann generieren.

Details: Verwendet

comfyui/image-blur-anything-sam2.jsonmit SAM2-Bildsegmentierung.

Hervorheben… (Bild) (image-highlight-anything-sam2)

Warum: Ausgewählte Motivbereiche in einem Standbild hervorheben.

Wie: Punkte/Rechtecke für das Motiv auswählen, dann generieren.

Details: Verwendet

comfyui/image-highlight-anything-sam2.jsonmit SAM2-Bildsegmentierung.

Maske… (Bild) (image-mask-anything-sam2)

Warum: Eine Bildmaske für ausgewählte Motivbereiche erzeugen.

Wie: Punkte/Rechtecke für das Motiv auswählen, dann generieren.

Details: Verwendet

comfyui/image-mask-anything-sam2.jsonmit SAM2-Bildsegmentierung.

Weichzeichnen… (Video) (video-blur-anything-sam2)

Warum: Ein sich bewegendes Motiv im Video verfolgen und weichzeichnen.

Wie: Motiv/Hintergrund im Bereichsbildschirm markieren, dann generieren.

Details: Verwendet

comfyui/video-blur-anything-sam2.jsonmit SAM2-Videoverfolgung.

Hervorheben… (Video) (video-highlight-anything-sam2)

Warum: Ein sich bewegendes Motiv im Video verfolgen und hervorheben.

Wie: Motiv/Hintergrund im Bereichsbildschirm markieren, dann generieren.

Details: Verwendet

comfyui/video-highlight-anything-sam2.jsonmit SAM2-Videoverfolgung.

Maske… (Video) (video-mask-anything-sam2)

Warum: Eine animierte Maske erzeugen, die einem sich bewegenden Motiv folgt.

Wie: Motiv/Hintergrund im Bereichsbildschirm markieren, dann generieren.

Details: Verwendet

comfyui/video-mask-anything-sam2.jsonmit SAM2-Videoverfolgung.

Einstiegspunkte für neue Benutzer

Wenn Sie neu bei diesen Werkzeugen sind, beginnen Sie mit:

Mit KI erstellen -> Bild

Mit KI verbessern -> Auflösung erhöhen

Mit KI verbessern -> Bewegung glätten

Mit KI verbessern -> In Szenen aufteilen

Mit KI verbessern -> Untertitel hinzufügen

Fehlerbehebung

Wenn KI-Menüs nicht erscheinen oder Aufgaben sofort fehlschlagen:

Überprüfen Sie, ob ComfyUI läuft und unter der konfigurierten URL erreichbar ist.

Bestätigen Sie, dass die erforderlichen Modelle in Ihrer ComfyUI-Umgebung vorhanden sind.

Bestätigen Sie, dass benutzerdefinierte Node-Pakete für den ausgewählten Workflow installiert sind.

Verringern Sie die Batch-/Chunk-Größen für lange Clips.

Testen Sie zuerst mit einem kurzen Clip oder einem Standbild erneut.

Für allgemeine Leistungs- und Cache-Optimierung siehe Einstellungen und Wiedergabe.