IA avancée : ComfyUI

OpenShot peut se connecter à un serveur ComfyUI local et exécuter des flux de travail d’IA à partir des menus contextuels des fichiers de projet et de la chronologie. Cette page explique ce que sont ces outils, le matériel dont ils ont besoin et où se trouvent les modèles de flux de travail intégrés.

Avertissement

Les fonctionnalités IA dans OpenShot sont expérimentales et nécessitent une station de travail haut de gamme.

Ces outils ne sont pas recommandés pour les ordinateurs portables, les ordinateurs de bureau milieu de gamme ou les systèmes économiques.

Vous devez exécuter un serveur local ComfyUI.

Vous devez vous attendre à des téléchargements de modèles, à des configurations et à des dépannages de flux de travail.

Matériel minimum recommandé

Composant |

Recommandation |

|---|---|

GPU |

NVIDIA 5070 12 Go ou mieux (16-24 Go de VRAM fortement préféré) |

CPU |

CPU Ryzen 9 5900 ou équivalent multi-cœur à haute fréquence |

Mémoire système |

64 Go de RAM ou plus |

Stockage |

200 Go d’espace libre pour les modèles, le cache et les sorties générées |

Expérience |

À l’aise avec les graphes ComfyUI, les modèles et les dépendances de nœuds |

Si votre système est en dessous de ces niveaux, les tâches vont se bloquer, échouer et produire des résultats instables. Si votre GPU dispose de 8 Go ou moins de VRAM, vous manquerez de mémoire lors de l’exécution de ces modèles.

Installation et configuration

Utilisez ce chemin d’installation rapide avant d’essayer un flux de travail IA dans OpenShot :

Installez ComfyUI et confirmez qu’il démarre correctement.

Installez les nœuds personnalisés requis (listés ci-dessous).

Téléchargez les fichiers modèles requis (listés ci-dessous) dans les dossiers modèles correspondants.

Démarrez ComfyUI, puis ouvrez Edit->Preferences->Advanced et définissez ComfyUI URL.

Cliquez sur Vérifier pour confirmer qu’OpenShot peut atteindre le serveur.

Pour un guide complet étape par étape de configuration du serveur, consultez le wiki OpenShot : ComfyUI : Guide avancé de configuration de l’IA.

Pour les détails complets d’installation de ComfyUI, consultez le dépôt officiel : ComfyUI sur GitHub.

Nœuds personnalisés requis

Modèles / fichiers requis

ComfyUI/models/diffusion_models/wan2.1_vace_1.3B_fp16.safetensorsComfyUI/custom_nodes/ComfyUI-Frame-Interpolation/ckpts/rife/rife47.pthComfyUI/models/checkpoints/sd_xl_base_1.0.safetensorsComfyUI/models/checkpoints/sd_xl_refiner_1.0.safetensorsComfyUI/models/checkpoints/stable-audio-open-1.0.safetensorsComfyUI/models/clip_vision/clip_vision_g.safetensorsComfyUI/models/diffusion_models/wan2.2_ti2v_5B_fp16.safetensorsComfyUI/models/grounding-dino/groundingdino_swint_ogc.pthComfyUI/models/sam2/sam2.1_hiera_base_plus.ptComfyUI/models/sam2/sam2.1_hiera_small-fp16.safetensorsComfyUI/models/sam2/sam2.1_hiera_small.ptComfyUI/models/sam2/sam2.1_hiera_tiny-fp16.safetensorsComfyUI/models/sam2/sam2.1_hiera_tiny.ptComfyUI/models/sam2/sam2_hiera_small.ptComfyUI/models/stt/whisper/large-v3.ptComfyUI/models/stt/whisper/medium.ptComfyUI/models/text_encoders/t5-base.safetensorsComfyUI/models/text_encoders/umt5_xxl_fp8_e4m3fn_scaled.safetensorsComfyUI/models/TTS/Ace-Step1.5/acestep-v15-turbo/silence_latent.ptComfyUI/models/upscale_models/RealESRGAN_x4plus.safetensorsComfyUI/models/vae/wan_2.1_vae.safetensorsComfyUI/models/vae/wan2.2_vae.safetensorsComfyUI/models/VLM/transnetv2-pytorch-weights/transnetv2-pytorch-weights.pth

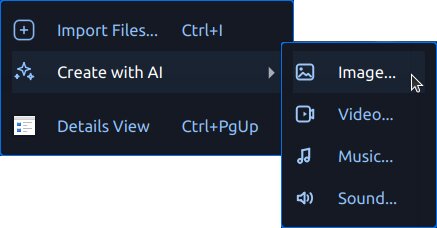

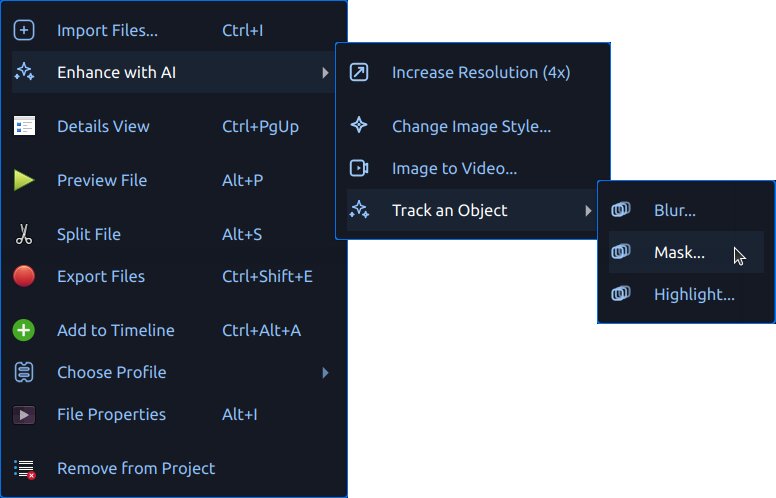

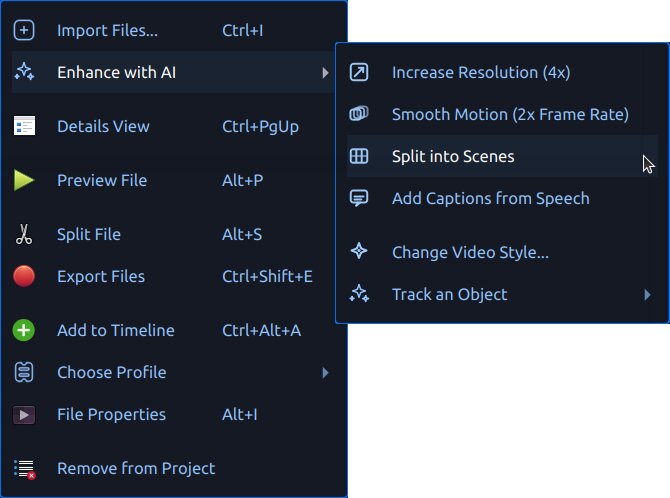

Ce que les utilisateurs voient dans OpenShot

Lorsque ComfyUI est disponible, OpenShot affiche les outils IA dans les menus contextuels :

Créer avec IA pour créer de nouveaux éléments

Améliorer avec IA (images) pour traiter les éléments image

Améliorer avec IA (vidéos) pour traiter les éléments vidéo

Les fichiers générés sont ajoutés à Project Files avec un texte de progression et des badges de file d’attente. Les sorties sont enregistrées sous .openshot_qt/comfyui-output/.

Démarrer un nouveau projet ou ouvrir un projet existant efface les dossiers de travail temporaires AI .openshot_qt pour que vous commenciez sur une base propre. Vos projets enregistrés ne sont pas affectés, et tous les actifs précédemment copiés dans un dossier PROJECTNAME_Assets restent dans le répertoire de ce projet.

Si ComfyUI n’est pas disponible, OpenShot désactive les menus AI. Configurez l’URL du serveur dans Edit->Preferences->Advanced, puis utilisez le bouton Check pour tester la connectivité.

Modèles de flux de travail

OpenShot lit les modèles intégrés depuis comfyui/. Il charge également des modèles utilisateur personnalisés depuis ~/.openshot_qt/comfyui/.

Pour ajouter votre propre flux de travail :

Dans ComfyUI, ouvrez l’onglet du flux de travail que vous souhaitez utiliser.

Choisissez Export (API) pour enregistrer le flux de travail en tant que fichier

*.json.Copiez ce fichier JSON dans

~/.openshot_qt/comfyui/.Redémarrez OpenShot, ou rouvrez le projet si nécessaire.

OpenShot chargera automatiquement le flux de travail et l’affichera dans le menu AI approprié. Lorsque vous le lancez depuis OpenShot, le fichier source sélectionné est transmis au flux de travail, et la sortie du nœud final du flux est importée dans Project Files.

OpenShot écrit également une charge utile .openshot_qt/comfyui/debug.json pour les utilisateurs avancés qui souhaitent inspecter la requête exacte envoyée à ComfyUI.

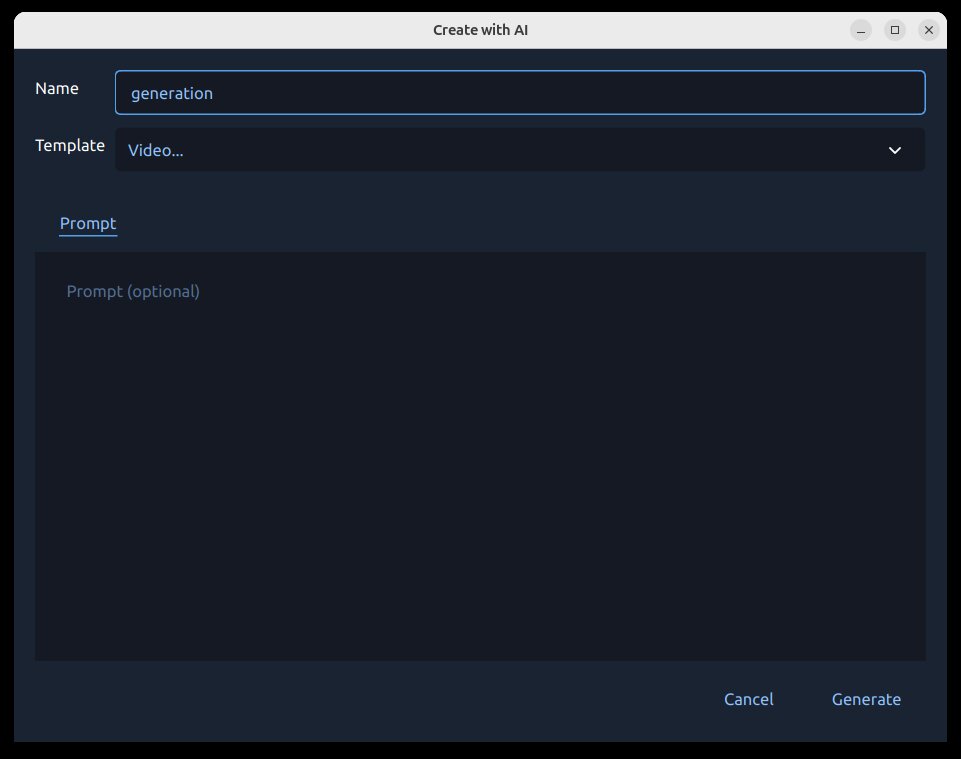

Dialogue d’action AI

Les options Create with AI et Enhance with AI ouvrent le même dialogue de génération.

Pourquoi ce dialogue est important :

Il regroupe toutes les entrées AI en un seul endroit.

Il valide les champs obligatoires avant de mettre la tâche en file d’attente.

Il vous permet de configurer les invites de suivi avant les exécutions coûteuses.

Ce que vous pouvez faire dans le dialogue :

Choisissez le flux de travail/l’action.

Saisissez le texte de l’invite.

Prévisualisez le fichier source sélectionné (pour les flux d’amélioration).

Définissez le nom de sortie pour les médias générés.

Choisissez une image de référence dans l’onglet Référence pour les flux de travail qui en nécessitent une.

Fournissez des points/rectangles de suivi pour les flux de travail de suivi.

Démarrez la tâche avec Generate ou fermez avec Cancel.

Suivi (Masque, Flou, Mise en évidence)

Les flux de travail de suivi (Blur…, Highlight…, Mask…) utilisent un écran de région où vous marquez ce qu’il faut inclure et ce qu’il faut ignorer.

Pourquoi c’est important

Le suivi aide votre effet à rester attaché à un sujet en mouvement au fil du temps. Par exemple, vous pouvez flouter un visage, mettre en évidence un joueur, ou générer un masque propre qui suit le même objet sur plusieurs images.

Icônes de suivi

Icône / Marqueur |

Signification |

|---|---|

Point bleu |

Coordonnée de suivi positive (point de départ du premier plan/sujet). |

Point rouge |

Coordonnée de suivi négative (point de départ de l’arrière-plan/exclusion). |

Rectangle bleu |

Point de départ de région positive (indice large du sujet). |

Rectangle rouge |

Point de départ de région négative (indice large d’exclusion). |

Icône de suppression |

Effacez toutes les graines de suivi actuelles (points/rectangles) et recommencez. |

Comment fonctionne le suivi

OpenShot envoie vos marqueurs positifs et négatifs comme coordonnées de départ au modèle de suivi, qui construit un masque pour le sujet puis le suit dans le temps. De meilleures graines produisent généralement des masques plus propres et moins de dérive. [sam2]

Comment l’utiliser

Choisissez une image où le sujet est clairement visible.

Commencez avec un point bleu sur le sujet.

Ajoutez des points rouges sur l’arrière-plan proche uniquement si nécessaire.

Ajoutez des rectangles lorsque vous avez besoin d’une sélection large plus rapide.

Répétez sur des images supplémentaires lorsque le mouvement/la forme change.

Ajustement dans le temps (curseur d’image) :

Déplacez le curseur d’image à différents moments du clip.

Ajoutez ou ajustez les points/rectangles sur les images où le suivi commence à dériver.

Utilisez des points de départ supplémentaires uniquement là où c’est nécessaire, surtout en cas d’occlusions, de mouvements rapides ou de changements majeurs de forme.

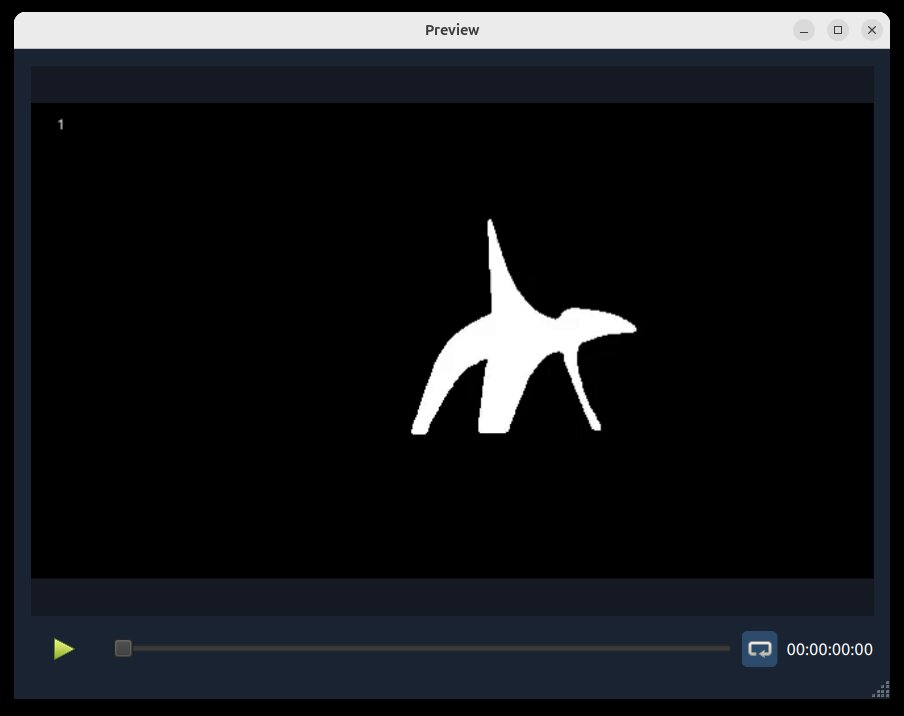

Sortie de prévisualisation du masque (de ce processus de suivi) :

Bonnes pratiques

Utilisez d’abord un court clip de test.

Commencez simplement : un seul point bleu suffit souvent.

Ajoutez plus de points uniquement là où le suivi échoue.

Si nécessaire, ajoutez un ensemble plus nuancé de points positifs/négatifs et de rectangles.

Gardez les points positifs et négatifs clairement séparés.

Si le suivi devient désordonné, utilisez l’icône Supprimer et recommencez avec des points de départ plus propres.

Projet SAM2 (Segment Anything Model 2) : facebookresearch/sam2

File d’attente des tâches, progression et annulation

Après avoir cliqué sur Générer, la requête est mise en file d’attente et s’exécute dans la file d’attente des tâches IA d’OpenShot.

La progression est affichée dans Fichiers du projet (badges et texte de statut).

Les résultats terminés sont réimportés dans Fichiers du projet.

Les tâches actives peuvent être annulées en cliquant avec le bouton droit sur le fichier de projet généré avec la barre de progression et en choisissant Cancel Job.

Les résultats sont enregistrés sous

.openshot_qt/comfyui-output/.

Flux de travail JSON intégrés

Les sections ci-dessous correspondent directement aux modèles JSON intégrés dans comfyui/. Chaque sous-section décrit pourquoi vous pouvez l’utiliser, comment l’exécuter et les détails clés.

Créer avec l’IA

Image… (txt2img-basic)

Pourquoi : Générer des images fixes à partir d’une invite textuelle.

Comment : Choisissez Créer avec l’IA -> Image…, saisissez une invite, puis générez.

Détails : utilise

comfyui/txt2img-basic.jsonavecsd_xl_base_1.0.safetensors.

Vidéo… (txt2video-svd)

Pourquoi : Générer de courts clips vidéo à partir de texte.

Comment : Choisissez Créer avec l’IA -> Vidéo…, saisissez une invite, puis générez.

Détails : utilise

comfyui/txt2video-svd.jsonavec les modèles de génération vidéo WAN.

Son… (txt2audio-stable-open)

Pourquoi : Générer des sons non musicaux à partir d’invites textuelles.

Comment : Choisissez Créer avec l’IA -> Son…, saisissez une invite, puis générez.

Détails : utilise

comfyui/txt2audio-stable-open.jsonavec les modèles Stable Audio Open.

Musique… (txt2music-ace-step)

Pourquoi : Générer de la musique à partir de styles/étiquettes (et paroles optionnelles).

Comment : Choisissez Créer avec l’IA -> Musique…, saisissez le texte de l’invite, puis générez.

Détails : utilise

comfyui/txt2music-ace-step.jsonavec un point de contrôle Ace-Step 1.5.

Améliorer avec l’IA

Changer le style de l’image… (img2img-basic)

Pourquoi : Re-styliser une image existante tout en conservant la composition d’origine.

Comment : Choisissez Améliorer avec l’IA sur une image, saisissez une invite de style, puis générez.

Détails : utilise

comfyui/img2img-basic.jsonavecsd_xl_base_1.0.safetensors.

Profondeur (image-extract-depth)

Pourquoi : Exporter une image de carte de profondeur en niveaux de gris à partir d’une image source.

Comment : Choisissez Améliorer avec l’IA -> Extraire -> Profondeur sur une image, puis générez.

Détails : Utilise

comfyui/image-extract-depth.jsonavecDepthAnythingV2Preprocessor.

Lignes (image-extract-lines)

Pourquoi : Exporter une image de carte de lignes à partir d’une image source.

Comment : Choisissez Améliorer avec l’IA -> Extraire -> Lignes sur une image, puis générez.

Détails : Utilise

comfyui/image-extract-lines.jsonavecLineArtPreprocessor.

Image vers Vidéo… (img2video-wan)

Pourquoi : Transformer une image fixe en une séquence vidéo générée.

Comment : Choisissez Améliorer avec l’IA sur une image, fournissez une invite, puis générez.

Détails : Utilise

comfyui/img2video-wan.jsonavec les modèles WAN 2.2 image-vers-vidéo.

Changer le style vidéo… (video2video-basic)

Pourquoi : Appliquer un nouveau style visuel à une vidéo source.

Comment : Choisissez Améliorer avec l’IA sur une vidéo, saisissez une invite de style, sélectionnez une image de référence dans l’onglet Référence, puis générez.

Détails : Utilise

comfyui/video2video-basic.jsonavec les nœuds vidéo-à-vidéo WAN VACE, une image de référence requise, une profondeur fusionnéeDepthAnythingV2Preprocessorplus un contrôle des contours Canny, ainsi que les modèleswan2.1_vace_1.3B_fp16.safetensors,wan_2.1_vae.safetensorsetumt5_xxl_fp8_e4m3fn_scaled.safetensors.

Profondeur (video-extract-depth)

Pourquoi : Exporter une version carte de profondeur en niveaux de gris d’une vidéo source.

Comment : Choisissez Améliorer avec l’IA -> Extraire -> Profondeur sur une vidéo, puis générez.

Détails : Utilise

comfyui/video-extract-depth.jsonavecDepthAnythingV2Preprocessoret conserve la fréquence d’images source.

Lignes (video-extract-lines)

Pourquoi : Exporter une version carte de lignes d’une vidéo source.

Comment : Choisissez Améliorer avec l’IA -> Extraire -> Lignes sur une vidéo, puis générez.

Détails : Utilise

comfyui/video-extract-lines.jsonavecLineArtPreprocessoret conserve la fréquence d’images source.

Augmenter la résolution (image) (upscale-realesrgan-x4)

Pourquoi : Améliorer la résolution des images basse définition.

Comment : Choisissez Améliorer avec l’IA sur une image, sélectionnez augmenter la résolution, puis générez.

Détails : utilise

comfyui/upscale-realesrgan-x4.jsonavecRealESRGAN_x4plus.safetensors.

Augmenter la résolution (vidéo) (video-upscale-gan)

Pourquoi : Améliorer la résolution des images vidéo pour plus de détails apparents.

Comment : Choisissez Améliorer avec l’IA sur une vidéo, sélectionnez augmenter la résolution, puis générez.

Détails : utilise

comfyui/video-upscale-gan.jsonavecRealESRGAN_x4plus.safetensors.

Mouvement fluide (fréquence d’images x2) (video-frame-interpolation-rife2x)

Pourquoi : Augmenter la fréquence d’images pour un mouvement perçu plus fluide.

Comment : Choisissez Améliorer avec l’IA sur une vidéo, sélectionnez mouvement fluide, puis générez.

Détails : utilise

comfyui/video-frame-interpolation-rife2x.jsonavecrife47.pth.

Diviser en scènes (video-segment-scenes-transnet)

Pourquoi : Détecter automatiquement les changements de scène et diviser les longs clips en segments.

Comment : Choisissez Améliorer avec l’IA sur une vidéo, sélectionnez division en scènes, puis générez.

Détails : utilise

comfyui/video-segment-scenes-transnet.jsonavec TransNetV2.

Ajouter des sous-titres à partir de la parole (video-whisper-srt)

Pourquoi : Transcrire la parole en fichiers de sous-titres/légendes.

Comment : Choisissez Améliorer avec l’IA sur une vidéo, sélectionnez les sous-titres, puis générez.

Détails : utilise

comfyui/video-whisper-srt.jsonet crée une sortie SRT.

Flux de travail de suivi (SAM2)

Ces flux de travail utilisent le même flux d’entrée de région/suivi et sont regroupés dans le menu contextuel de suivi.

Flouter… (image) (image-blur-anything-sam2)

Pourquoi : Flouter les zones de sujet sélectionnées dans une image fixe.

Comment : Sélectionnez des points/rectangles pour le sujet, puis générez.

Détails : utilise

comfyui/image-blur-anything-sam2.jsonavec la segmentation d’image SAM2.

Mettre en évidence… (image) (image-highlight-anything-sam2)

Pourquoi : Mettre en valeur les zones de sujet sélectionnées dans une image fixe.

Comment : Sélectionnez des points/rectangles pour le sujet, puis générez.

Détails : utilise

comfyui/image-highlight-anything-sam2.jsonavec la segmentation d’image SAM2.

Masque… (image) (image-mask-anything-sam2)

Pourquoi : Générer un masque d’image pour les zones de sujet sélectionnées.

Comment : Sélectionnez des points/rectangles pour le sujet, puis générez.

Détails : utilise

comfyui/image-mask-anything-sam2.jsonavec la segmentation d’image SAM2.

Flouter… (vidéo) (video-blur-anything-sam2)

Pourquoi : Suivre et flouter un sujet en mouvement dans une vidéo.

Comment : Marquez le sujet/arrière-plan dans l’écran de région, puis générez.

Détails : utilise

comfyui/video-blur-anything-sam2.jsonavec le suivi vidéo SAM2.

Mettre en évidence… (vidéo) (video-highlight-anything-sam2)

Pourquoi : Suivre et mettre en évidence un sujet en mouvement dans une vidéo.

Comment : Marquez le sujet/arrière-plan dans l’écran de région, puis générez.

Détails : utilise

comfyui/video-highlight-anything-sam2.jsonavec le suivi vidéo SAM2.

Masque… (vidéo) (video-mask-anything-sam2)

Pourquoi : Générer un masque animé qui suit un sujet en mouvement.

Comment : Marquez le sujet/arrière-plan dans l’écran de région, puis générez.

Détails : utilise

comfyui/video-mask-anything-sam2.jsonavec le suivi vidéo SAM2.

Points de départ pour les nouveaux utilisateurs

Si vous êtes nouveau avec ces outils, commencez par :

Créer avec l’IA -> Image

Améliorer avec l’IA -> Augmenter la résolution

Améliorer avec l’IA -> Fluidifier le mouvement

Améliorer avec l’IA -> Diviser en scènes

Améliorer avec l’IA -> Ajouter des sous-titres

Dépannage

Si les menus IA n’apparaissent pas ou si les tâches échouent immédiatement :

Vérifiez que ComfyUI fonctionne et est accessible à l’URL configurée.

Confirmez que les modèles requis existent dans votre environnement ComfyUI.

Confirmez que les paquets de nœuds personnalisés sont installés pour le flux de travail que vous avez sélectionné.

Réduisez la taille des lots/morceaux pour les clips longs.

Testez d’abord avec un clip court ou une image fixe.

Pour l’optimisation générale des performances et du cache, consultez Préférences et Lecture.