Zaawansowana AI: ComfyUI

OpenShot może połączyć się z lokalnym serwerem ComfyUI i uruchamiać przepływy pracy AI z menu kontekstowych Pliki projektu i Oś czasu. Na tej stronie wyjaśniono, czym są te narzędzia, jakiego sprzętu wymagają i gdzie znajdują się wbudowane szablony przepływu pracy.

Ostrzeżenie

Funkcje AI w OpenShot są eksperymentalne i wymagają wydajnej stacji roboczej.

Te narzędzia nie są zalecane dla laptopów, komputerów stacjonarnych średniej klasy ani systemów budżetowych.

Musisz uruchomić lokalny serwer ComfyUI.

Powinieneś spodziewać się pobierania modeli, konfiguracji oraz rozwiązywania problemów z przepływami pracy.

Minimalny zalecany sprzęt

Komponent |

Zalecenie |

|---|---|

GPU |

NVIDIA 5070 12 GB lub lepsza (zdecydowanie preferowane 16-24 GB VRAM) |

CPU |

Procesor klasy Ryzen 9 5900 (lub równoważny wielordzeniowy o wysokim taktowaniu) |

Pamięć systemowa |

64GB RAM lub więcej |

Pamięć masowa |

200GB wolnego miejsca na modele, pamięć podręczną i wygenerowane pliki |

Doświadczenie |

Znajomość grafów ComfyUI, modeli i zależności węzłów |

Jeśli Twój system jest poniżej tych wymagań, zadania będą się zawieszać, nie powiodą się i wygenerują niestabilne wyniki. Jeśli Twoja karta GPU ma 8GB lub mniej VRAM, zabraknie pamięci podczas uruchamiania tych modeli.

Instalacja i konfiguracja

Użyj tej szybkiej ścieżki konfiguracji przed wypróbowaniem jakiegokolwiek przepływu pracy AI w OpenShot:

Zainstaluj ComfyUI i potwierdź, że uruchamia się poprawnie.

Zainstaluj wymagane niestandardowe węzły (wymienione poniżej).

Pobierz wymagane pliki modeli (wymienione poniżej) do odpowiednich folderów modeli.

Uruchom ComfyUI, następnie otwórz Edit->Preferences->Advanced i ustaw ComfyUI URL.

Kliknij Sprawdź, aby potwierdzić, że OpenShot może połączyć się z serwerem.

Aby uzyskać pełny przewodnik krok po kroku dotyczący konfiguracji serwera, zobacz wiki OpenShot: ComfyUI: Advanced AI Setup Guide.

Pełne informacje o instalacji ComfyUI znajdziesz w oficjalnym repozytorium: ComfyUI na GitHub.

Wymagane niestandardowe węzły

Wymagane modele / pliki

ComfyUI/models/diffusion_models/wan2.1_vace_1.3B_fp16.safetensorsComfyUI/custom_nodes/ComfyUI-Frame-Interpolation/ckpts/rife/rife47.pthComfyUI/models/checkpoints/sd_xl_base_1.0.safetensorsComfyUI/models/checkpoints/sd_xl_refiner_1.0.safetensorsComfyUI/models/checkpoints/stable-audio-open-1.0.safetensorsComfyUI/models/clip_vision/clip_vision_g.safetensorsComfyUI/models/diffusion_models/wan2.2_ti2v_5B_fp16.safetensorsComfyUI/models/grounding-dino/groundingdino_swint_ogc.pthComfyUI/models/sam2/sam2.1_hiera_base_plus.ptComfyUI/models/sam2/sam2.1_hiera_small-fp16.safetensorsComfyUI/models/sam2/sam2.1_hiera_small.ptComfyUI/models/sam2/sam2.1_hiera_tiny-fp16.safetensorsComfyUI/models/sam2/sam2.1_hiera_tiny.ptComfyUI/models/sam2/sam2_hiera_small.ptComfyUI/models/stt/whisper/large-v3.ptComfyUI/models/stt/whisper/medium.ptComfyUI/models/text_encoders/t5-base.safetensorsComfyUI/models/text_encoders/umt5_xxl_fp8_e4m3fn_scaled.safetensorsComfyUI/models/TTS/Ace-Step1.5/acestep-v15-turbo/silence_latent.ptComfyUI/models/upscale_models/RealESRGAN_x4plus.safetensorsComfyUI/models/vae/wan_2.1_vae.safetensorsComfyUI/models/vae/wan2.2_vae.safetensorsComfyUI/models/VLM/transnetv2-pytorch-weights/transnetv2-pytorch-weights.pth

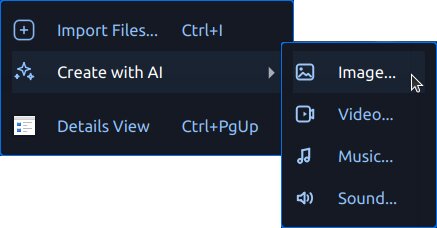

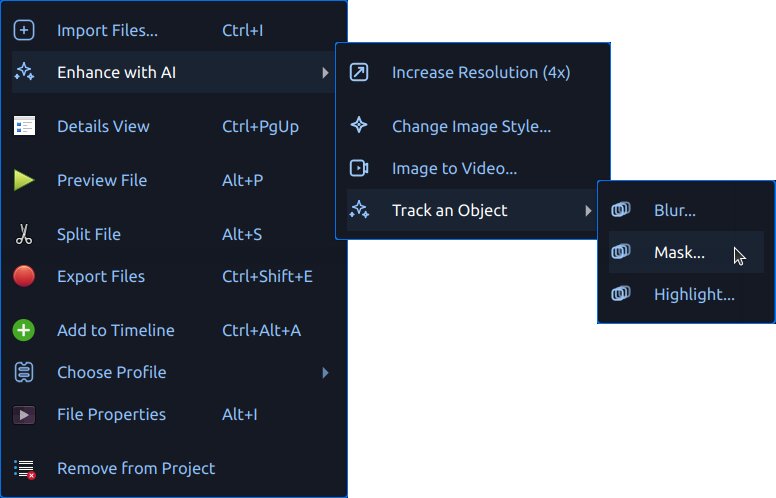

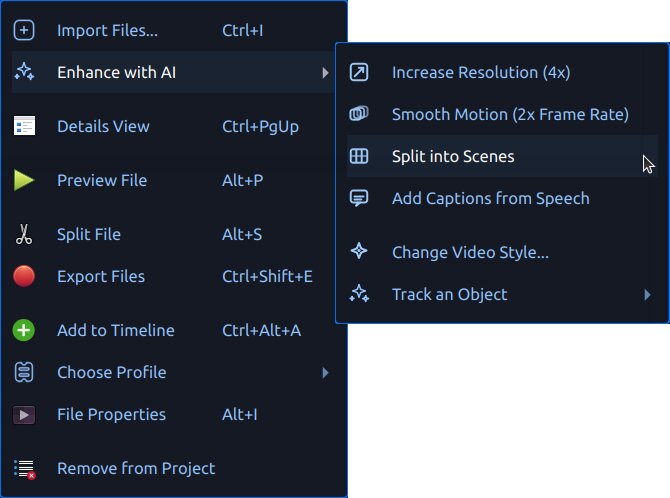

Co użytkownicy widzą w OpenShot

Gdy ComfyUI jest dostępny, OpenShot pokazuje narzędzia AI w menu kontekstowych:

Utwórz za pomocą AI do tworzenia nowych zasobów

Ulepsz za pomocą AI (obrazy) do przetwarzania zasobów obrazów

Ulepsz za pomocą AI (wideo) do przetwarzania zasobów wideo

Wygenerowane pliki są dodawane do Pliki projektu z tekstem postępu i odznakami kolejki. Wyniki są zapisywane w katalogu .openshot_qt/comfyui-output/.

Rozpoczęcie nowego projektu lub otwarcie istniejącego projektu czyści tymczasowe foldery robocze AI .openshot_qt, dzięki czemu zaczynasz z czystą kartą. Twoje zapisane projekty nie są modyfikowane, a wszelkie zasoby wcześniej skopiowane do folderu PROJECTNAME_Assets pozostają w katalogu tego projektu.

Jeśli ComfyUI jest niedostępny, OpenShot wyłącza menu AI. Skonfiguruj adres URL serwera w Edit->Preferences->Advanced, a następnie użyj przycisku Check, aby przetestować łączność.

Szablony przepływów pracy

OpenShot czyta wbudowane szablony z comfyui/. Ładuje także niestandardowe szablony użytkownika z ~/.openshot_qt/comfyui/.

Aby dodać własny przepływ pracy:

W ComfyUI otwórz zakładkę przepływu pracy, której chcesz użyć.

Wybierz Eksportuj (API), aby zapisać przepływ pracy jako plik

*.json.Skopiuj ten plik JSON do katalogu

~/.openshot_qt/comfyui/.Uruchom ponownie OpenShot lub w razie potrzeby otwórz ponownie projekt.

OpenShot automatycznie załaduje przepływ pracy i wyświetli go w odpowiednim menu AI. Po uruchomieniu z OpenShot wybrany plik źródłowy jest przekazywany do przepływu pracy, a wynik z końcowego węzła wyjściowego jest importowany z powrotem do Pliki projektu.

OpenShot zapisuje również ładunek .openshot_qt/comfyui/debug.json dla zaawansowanych użytkowników, którzy chcą sprawdzić dokładne żądanie wysłane do ComfyUI.

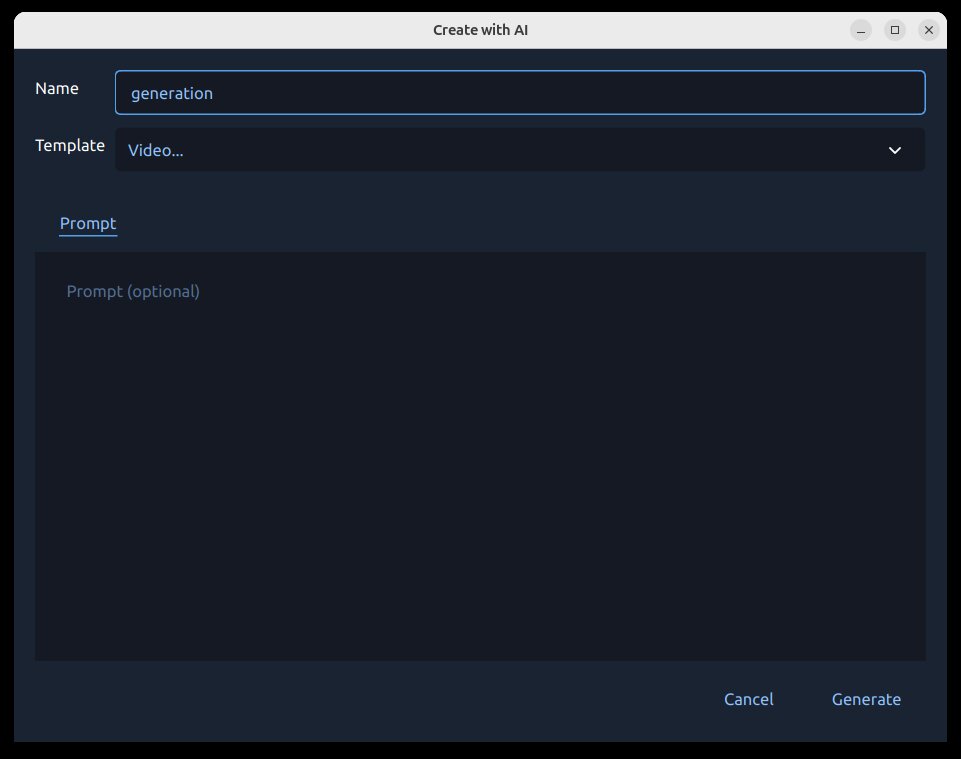

Okno dialogowe akcji AI

Zarówno Utwórz za pomocą AI, jak i Ulepsz za pomocą AI otwierają to samo okno dialogowe generowania.

Dlaczego to okno dialogowe jest ważne:

Zbiera wszystkie dane wejściowe AI w jednym miejscu.

Weryfikuje wymagane pola przed dodaniem zadania do kolejki.

Pozwala ustawić punkty śledzenia przed kosztownymi operacjami.

Co możesz zrobić w tym oknie dialogowym:

Wybierz przepływ pracy/akcję.

Wprowadź tekst polecenia.

Podejrzyj wybrany plik źródłowy (dla przepływów ulepszających).

Ustaw nazwę wyjściową dla wygenerowanych mediów.

Wybierz obraz referencyjny na karcie Reference dla przepływów pracy, które tego wymagają.

Podaj punkty/prostokąty śledzenia dla przepływów śledzących.

Rozpocznij zadanie przyciskiem Generuj lub zamknij przyciskiem Anuluj.

Śledzenie (Maska, Rozmycie, Podświetlenie)

Przepływy śledzenia (Rozmycie…, Podświetlenie…, Maska…) używają ekranu regionu, na którym zaznaczasz, co uwzględnić, a co pominąć.

Dlaczego to jest ważne

Śledzenie pomaga efektowi pozostać przypiętym do poruszającego się obiektu w czasie. Na przykład możesz rozmyć twarz, podświetlić zawodnika lub wygenerować czystą maskę, która podąża za tym samym obiektem przez wiele klatek.

Ikony śledzenia

Ikona / Znacznik |

Znaczenie |

|---|---|

Niebieska kropka |

Pozytywny punkt śledzenia (punkt startowy pierwszego planu/obiektu). |

Czerwona kropka |

Negatywny punkt śledzenia (punkt startowy tła/wykluczenia). |

Niebieski prostokąt |

Pozytywny punkt startowy regionu (szeroka wskazówka obiektu). |

Czerwony prostokąt |

Negatywny punkt startowy regionu (szeroka wskazówka wykluczenia). |

Usuń ikonę |

Wyczyść wszystkie obecne punkty startowe śledzenia (kropki/prostokąty) i zacznij od nowa. |

Jak działa śledzenie

OpenShot wysyła twoje pozytywne i negatywne znaczniki jako współrzędne startowe do modelu śledzenia, który tworzy maskę dla obiektu, a następnie śledzi ją w czasie. Lepsze punkty startowe zwykle dają czystsze maski i mniejsze przesunięcia. [sam2]

Jak z tego korzystać

Wybierz klatkę, na której obiekt jest wyraźnie widoczny.

Zacznij od jednej niebieskiej kropki na obiekcie.

Dodaj czerwone kropki na pobliskim tle tylko jeśli to konieczne.

Dodaj prostokąty, gdy potrzebujesz szybszego szerokiego zaznaczenia.

Powtórz na kolejnych klatkach, gdy zmienia się ruch/kształt.

Dostosowywanie w czasie (suwak klatek):

Przesuń suwak klatek do różnych momentów w klipie.

Dodaj lub dostosuj kropki/prostokąty na klatkach, gdzie śledzenie zaczyna się przesuwać.

Używaj dodatkowych punktów startowych tylko tam, gdzie to konieczne, szczególnie przy zasłonięciach, szybkim ruchu lub dużych zmianach kształtu.

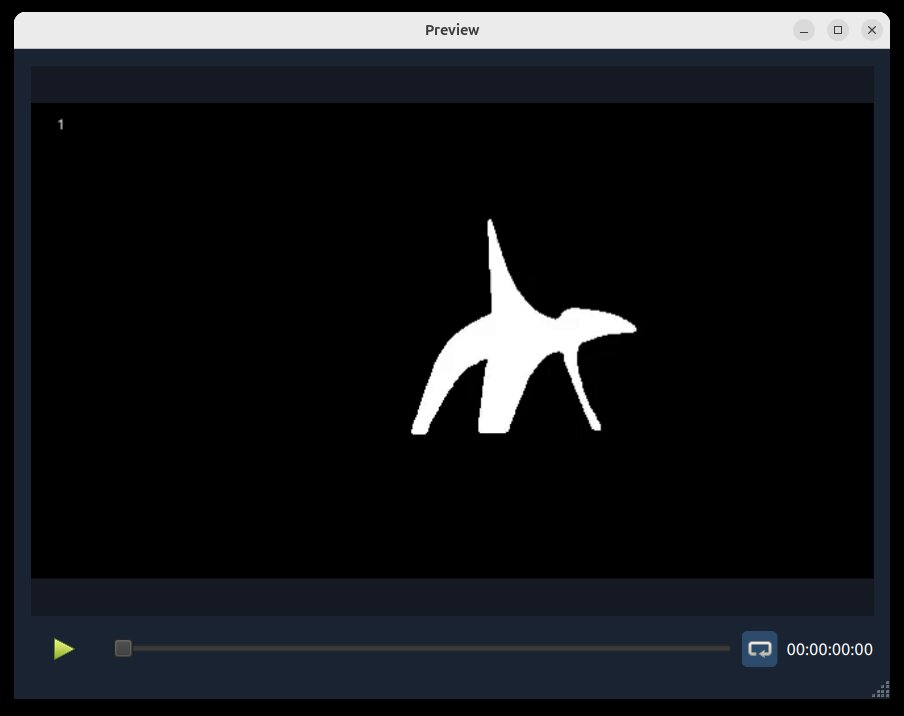

Podgląd maski wyjściowej (z tego procesu śledzenia):

Najlepsze praktyki

Najpierw użyj krótkiego klipu testowego.

Zacznij prosto: jedna niebieska kropka często wystarcza.

Dodawaj więcej punktów tylko tam, gdzie śledzenie zawodzi.

W razie potrzeby dodaj bardziej szczegółowy zestaw punktów i prostokątów pozytywnych/negatywnych.

Wyraźnie oddziel punkty pozytywne od negatywnych.

Jeśli śledzenie stanie się nieczytelne, użyj ikony Usuń i zacznij od nowa z czystszymi punktami startowymi.

Projekt SAM2 (Segment Anything Model 2): facebookresearch/sam2

Kolejka zadań, postęp i anulowanie

Po kliknięciu Generuj, żądanie trafia do kolejki i jest wykonywane w kolejce zadań AI OpenShot.

Postęp jest wyświetlany w Plikach projektu (odznaki i tekst statusu).

Zakończone wyniki są importowane z powrotem do Plików projektu.

Aktywne zadania można anulować, klikając prawym przyciskiem myszy wygenerowany plik projektu z paskiem postępu i wybierając Anuluj zadanie.

Wyniki są zapisywane w katalogu

.openshot_qt/comfyui-output/.

Wbudowane przepływy pracy JSON

Poniższe sekcje odnoszą się bezpośrednio do wbudowanych szablonów JSON w comfyui/. Każda podsekcja opisuje, dlaczego możesz z niego korzystać, jak go uruchomić i najważniejsze szczegóły.

Twórz z AI

Obraz… (txt2img-basic)

Dlaczego: Generuj statyczne obrazy na podstawie tekstowego opisu.

Jak: Wybierz Twórz z AI -> Obraz…, wpisz opis, a następnie generuj.

Szczegóły: Używa

comfyui/txt2img-basic.jsonzsd_xl_base_1.0.safetensors.

Wideo… (txt2video-svd)

Dlaczego: Generuj krótkie klipy wideo na podstawie tekstu.

Jak: Wybierz Twórz z AI -> Wideo…, wpisz opis, a następnie generuj.

Szczegóły: Wykorzystuje plik

comfyui/txt2video-svd.jsonz modelami generowania wideo w sieci WAN.

Dźwięk… (txt2audio-stable-open)

Dlaczego: Generuj dźwięki niemuzyczne na podstawie tekstowych opisów.

Jak: Wybierz Twórz z AI -> Dźwięk…, wpisz opis, a następnie generuj.

Szczegóły: Używa

comfyui/txt2audio-stable-open.jsonz modelami Stable Audio Open.

Muzyka… (txt2music-ace-step)

Dlaczego: Generuj muzykę na podstawie stylu/tagów (i opcjonalnie tekstu piosenki).

Jak: Wybierz Twórz z AI -> Muzyka…, wpisz tekst opisu, a następnie generuj.

Szczegóły: Używa

comfyui/txt2music-ace-step.jsonz punktem kontrolnym Ace-Step 1.5.

Ulepszaj z AI

Zmień styl obrazu… (img2img-basic)

Dlaczego: Zmień styl istniejącego obrazu, zachowując jego kompozycję.

Jak: Wybierz Ulepszaj z AI na obrazie, wpisz opis stylu, a następnie generuj.

Szczegóły: Używa

comfyui/img2img-basic.jsonzsd_xl_base_1.0.safetensors.

Głębia (image-extract-depth)

Dlaczego: Eksportuj obraz mapy głębi w skali szarości ze źródłowego obrazu.

Jak: Wybierz Enhance with AI -> Extract -> Depth na obrazie, a następnie wygeneruj.

Szczegóły: Używa

comfyui/image-extract-depth.jsonzDepthAnythingV2Preprocessor.

Linie (image-extract-lines)

Dlaczego: Eksportuj obraz mapy linii ze źródłowego obrazu.

Jak: Wybierz Enhance with AI -> Extract -> Lines na obrazie, a następnie wygeneruj.

Szczegóły: Używa

comfyui/image-extract-lines.jsonzLineArtPreprocessor.

Obraz do wideo… (img2video-wan)

Dlaczego: Zamień statyczny obraz w wygenerowany klip wideo.

Jak: Wybierz Ulepszaj z AI na obrazie, podaj wskazówki w opisie, a następnie generuj.

Szczegóły: Używa

comfyui/img2video-wan.jsonz modelami WAN 2.2 do konwersji obrazu na wideo.

Zmień styl wideo… (video2video-basic)

Dlaczego: Zastosuj nowy styl wizualny do źródłowego wideo.

Jak: Wybierz Enhance with AI na wideo, wpisz polecenie stylu, wybierz obraz referencyjny na karcie Reference, a następnie wygeneruj.

Szczegóły: Używa

comfyui/video2video-basic.jsonz węzłami WAN VACE video-to-video, wymaganym obrazem referencyjnym, połączoną głębiąDepthAnythingV2Preprocessororaz kontrolą krawędzi Canny, a także modelamiwan2.1_vace_1.3B_fp16.safetensors,wan_2.1_vae.safetensorsiumt5_xxl_fp8_e4m3fn_scaled.safetensors.

Głębia (video-extract-depth)

Dlaczego: Eksportuj wersję mapy głębi w skali szarości ze źródłowego wideo.

Jak: Wybierz Enhance with AI -> Extract -> Depth na wideo, a następnie wygeneruj.

Szczegóły: Używa

comfyui/video-extract-depth.jsonzDepthAnythingV2Preprocessori zachowuje oryginalną liczbę klatek na sekundę.

Linie (video-extract-lines)

Dlaczego: Eksportuj wersję mapy linii ze źródłowego wideo.

Jak: Wybierz Enhance with AI -> Extract -> Lines na wideo, a następnie wygeneruj.

Szczegóły: Używa

comfyui/video-extract-lines.jsonzLineArtPreprocessori zachowuje oryginalną liczbę klatek na sekundę.

Zwiększ rozdzielczość (obraz) (upscale-realesrgan-x4)

Dlaczego: Powiększ obrazy o niskiej rozdzielczości.

Jak: Wybierz Ulepszaj z AI na obrazie, wybierz zwiększenie rozdzielczości, a następnie generuj.

Szczegóły: Używa

comfyui/upscale-realesrgan-x4.jsonzRealESRGAN_x4plus.safetensors.

Zwiększ rozdzielczość (wideo) (video-upscale-gan)

Dlaczego: Powiększ klatki wideo dla wyższej widocznej szczegółowości.

Jak: Wybierz Ulepszaj z AI na wideo, wybierz zwiększenie rozdzielczości, a następnie generuj.

Szczegóły: Używa

comfyui/video-upscale-gan.jsonzRealESRGAN_x4plus.safetensors.

Płynny ruch (2x liczba klatek) (video-frame-interpolation-rife2x)

Dlaczego: Zwiększ liczbę klatek, aby ruch był postrzegany jako płynniejszy.

Jak: Wybierz Ulepszaj z AI na wideo, wybierz płynny ruch, a następnie generuj.

Szczegóły: Używa

comfyui/video-frame-interpolation-rife2x.jsonzrife47.pth.

Podziel na sceny (video-segment-scenes-transnet)

Dlaczego: Automatycznie wykrywaj zmiany scen i dziel długie klipy na segmenty.

Jak: Wybierz Ulepszaj z AI na wideo, wybierz podział na sceny, a następnie generuj.

Szczegóły: Używa

comfyui/video-segment-scenes-transnet.jsonz TransNetV2.

Dodaj napisy z mowy (video-whisper-srt)

Dlaczego: Transkrybuj mowę do plików z napisami/tytułami.

Jak: Wybierz Ulepsz za pomocą AI na wideo, wybierz napisy, a następnie wygeneruj.

Szczegóły: Używa

comfyui/video-whisper-srt.jsoni tworzy wyjście SRT.

Ścieżki pracy śledzenia (SAM2)

Te ścieżki pracy używają tego samego przepływu wejściowego regionu/śledzenia i są pogrupowane w menu kontekstowym śledzenia.

Rozmycie… (obraz) (image-blur-anything-sam2)

Dlaczego: Rozmyj wybrane obszary obiektu na nieruchomym obrazie.

Jak: Wybierz punkty/prostokąty dla obiektu, a następnie wygeneruj.

Szczegóły: Używa

comfyui/image-blur-anything-sam2.jsonz segmentacją obrazu SAM2.

Podświetl… (obraz) (image-highlight-anything-sam2)

Dlaczego: Podkreśl wybrane obszary obiektu na nieruchomym obrazie.

Jak: Wybierz punkty/prostokąty dla obiektu, a następnie wygeneruj.

Szczegóły: Używa

comfyui/image-highlight-anything-sam2.jsonz segmentacją obrazu SAM2.

Maska… (obraz) (image-mask-anything-sam2)

Dlaczego: Wygeneruj maskę obrazu dla wybranych obszarów obiektu.

Jak: Wybierz punkty/prostokąty dla obiektu, a następnie wygeneruj.

Szczegóły: Używa

comfyui/image-mask-anything-sam2.jsonz segmentacją obrazu SAM2.

Rozmycie… (wideo) (video-blur-anything-sam2)

Dlaczego: Śledź i rozmyj poruszający się obiekt na wideo.

Jak: Oznacz obiekt/tło na ekranie regionu, a następnie wygeneruj.

Szczegóły: Używa

comfyui/video-blur-anything-sam2.jsonze śledzeniem wideo SAM2.

Podświetl… (wideo) (video-highlight-anything-sam2)

Dlaczego: Śledź i podświetl poruszający się obiekt na wideo.

Jak: Oznacz obiekt/tło na ekranie regionu, a następnie wygeneruj.

Szczegóły: Używa

comfyui/video-highlight-anything-sam2.jsonze śledzeniem wideo SAM2.

Maska… (wideo) (video-mask-anything-sam2)

Dlaczego: Wygeneruj animowaną maskę, która podąża za poruszającym się obiektem.

Jak: Oznacz obiekt/tło na ekranie regionu, a następnie wygeneruj.

Szczegóły: Używa

comfyui/video-mask-anything-sam2.jsonze śledzeniem wideo SAM2.

Punkty startowe dla nowych użytkowników

Jeśli jesteś nowy w tych narzędziach, zacznij od:

Utwórz za pomocą AI -> Obraz

Ulepsz za pomocą AI -> Zwiększ rozdzielczość

Ulepsz za pomocą AI -> Wygładź ruch

Ulepsz za pomocą AI -> Podziel na sceny

Ulepsz za pomocą AI -> Dodaj napisy

Rozwiązywanie problemów

Jeśli menu AI się nie pojawiają lub zadania od razu się nie powiodą:

Sprawdź, czy ComfyUI działa i jest dostępny pod skonfigurowanym adresem URL.

Potwierdź, że wymagane modele istnieją w Twoim środowisku ComfyUI.

Potwierdź, że niestandardowe pakiety węzłów są zainstalowane dla wybranego przepływu pracy.

Zmniejsz rozmiary partii/kawałków dla długich klipów.

Najpierw przetestuj ponownie na krótkim klipie lub nieruchomym obrazie.

Aby poprawić ogólną wydajność i dostroić pamięć podręczną, zobacz Preferencje i Odtwarzanie.