IA avanzada: ComfyUI

OpenShot puede conectarse a un servidor ComfyUI local y ejecutar flujos de trabajo de IA desde los menús contextuales Archivos de proyecto y Línea de tiempo. Esta página explica qué son estas herramientas, qué hardware requieren y dónde se encuentran las plantillas de flujo de trabajo integradas.

Advertencia

Las funciones de IA en OpenShot son experimentales y requieren una estación de trabajo de alta gama.

Estas herramientas no se recomiendan para laptops, escritorios de gama media o sistemas económicos.

Debe ejecutar un servidor local ComfyUI.

Debe esperar descargas de modelos, configuración y solución de problemas del flujo de trabajo.

Hardware mínimo recomendado

Componente |

Recomendación |

|---|---|

GPU |

NVIDIA 5070 12 GB o mejor (se prefiere entre 16 y 24 GB de VRAM) |

CPU |

CPU clase Ryzen 9 5900 (o equivalente multinúcleo de alta frecuencia) |

Memoria del sistema |

64GB de RAM o más |

Almacenamiento |

200GB de espacio libre para modelos, caché y salidas generadas |

Experiencia |

Familiarizado con gráficos, modelos y dependencias de nodos de ComfyUI |

Si su sistema está por debajo de estos niveles, los trabajos se detendrán, fallarán y producirán resultados inestables. Si su GPU tiene 8GB o menos de VRAM, se quedará sin memoria al ejecutar estos modelos.

Instalación y configuración

Use esta ruta de configuración rápida antes de probar cualquier flujo de trabajo de IA en OpenShot:

Instale ComfyUI y confirme que se inicia correctamente.

Instale los nodos personalizados requeridos (listados a continuación).

Descargue los archivos de modelos requeridos (listados a continuación) en las carpetas de modelos correspondientes.

Inicie ComfyUI, luego abra Editar->Preferencias->Avanzado y configure ComfyUI URL.

Haga clic en Comprobar para confirmar que OpenShot puede acceder al servidor.

Para una guía completa paso a paso de configuración del servidor, consulte el wiki de OpenShot: ComfyUI: Guía avanzada de configuración de IA.

Para detalles completos de la instalación de ComfyUI, consulte el repositorio oficial: ComfyUI en GitHub.

Nodos personalizados requeridos

Modelos / Archivos requeridos

ComfyUI/models/diffusion_models/wan2.1_vace_1.3B_fp16.safetensorsComfyUI/custom_nodes/ComfyUI-Frame-Interpolation/ckpts/rife/rife47.pthComfyUI/models/checkpoints/sd_xl_base_1.0.safetensorsComfyUI/models/checkpoints/sd_xl_refiner_1.0.safetensorsComfyUI/models/checkpoints/stable-audio-open-1.0.safetensorsComfyUI/models/clip_vision/clip_vision_g.safetensorsComfyUI/models/diffusion_models/wan2.2_ti2v_5B_fp16.safetensorsComfyUI/models/grounding-dino/groundingdino_swint_ogc.pthComfyUI/models/sam2/sam2.1_hiera_base_plus.ptComfyUI/models/sam2/sam2.1_hiera_small-fp16.safetensorsComfyUI/models/sam2/sam2.1_hiera_small.ptComfyUI/models/sam2/sam2.1_hiera_tiny-fp16.safetensorsComfyUI/models/sam2/sam2.1_hiera_tiny.ptComfyUI/models/sam2/sam2_hiera_small.ptComfyUI/models/stt/whisper/large-v3.ptComfyUI/models/stt/whisper/medium.ptComfyUI/models/text_encoders/t5-base.safetensorsComfyUI/models/text_encoders/umt5_xxl_fp8_e4m3fn_scaled.safetensorsComfyUI/models/TTS/Ace-Step1.5/acestep-v15-turbo/silence_latent.ptComfyUI/models/upscale_models/RealESRGAN_x4plus.safetensorsComfyUI/models/vae/wan_2.1_vae.safetensorsComfyUI/models/vae/wan2.2_vae.safetensorsComfyUI/models/VLM/transnetv2-pytorch-weights/transnetv2-pytorch-weights.pth

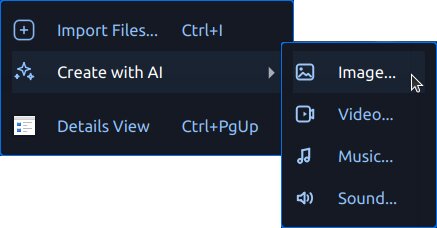

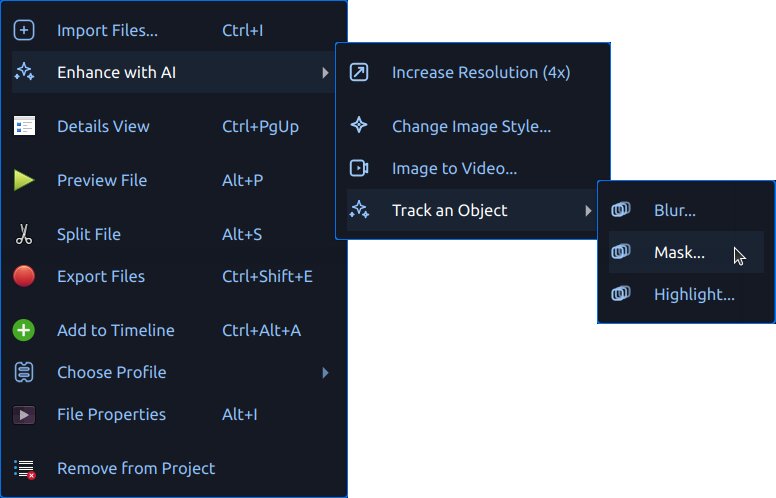

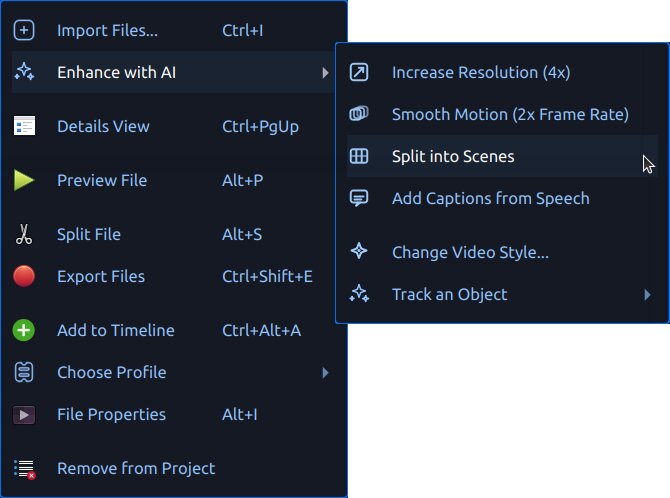

Lo que los usuarios ven en OpenShot

Cuando ComfyUI está disponible, OpenShot muestra herramientas de IA en los menús contextuales:

Crear con IA para crear nuevos recursos

Mejorar con IA (imágenes) para procesar recursos de imagen

Mejorar con IA (videos) para procesar recursos de video

Los archivos generados se añaden a Archivos del proyecto con texto de progreso y distintivos de cola. Las salidas se guardan en .openshot_qt/comfyui-output/.

Iniciar un nuevo proyecto o abrir un proyecto existente borra las carpetas temporales de trabajo de IA .openshot_qt para que comiences con una pizarra limpia. Tus proyectos guardados no se ven afectados, y cualquier recurso copiado previamente en una carpeta PROJECTNAME_Assets permanece en el directorio de ese proyecto.

Si ComfyUI no está disponible, OpenShot desactiva los menús de IA. Configure la URL del servidor en Editar->Preferencias->Avanzado, luego use el botón Verificar para probar la conectividad.

Plantillas de flujo de trabajo

OpenShot lee plantillas integradas de comfyui/. También carga plantillas de usuario personalizadas desde ~/.openshot_qt/comfyui/.

Para añadir tu propio flujo de trabajo:

En ComfyUI, abre la pestaña del flujo de trabajo que deseas usar.

Elige Exportar (API) para guardar el flujo de trabajo como un archivo

*.json.Copia ese archivo JSON en

~/.openshot_qt/comfyui/.Reinicia OpenShot o vuelve a abrir el proyecto si es necesario.

OpenShot cargará automáticamente el flujo de trabajo y lo mostrará en el menú de IA correspondiente. Cuando lo activas desde OpenShot, el archivo fuente seleccionado se pasa al flujo de trabajo, y la salida del nodo final del flujo se importa de nuevo en Archivos del proyecto.

OpenShot también escribe una carga útil .openshot_qt/comfyui/debug.json para usuarios avanzados que quieran inspeccionar la solicitud exacta enviada a ComfyUI.

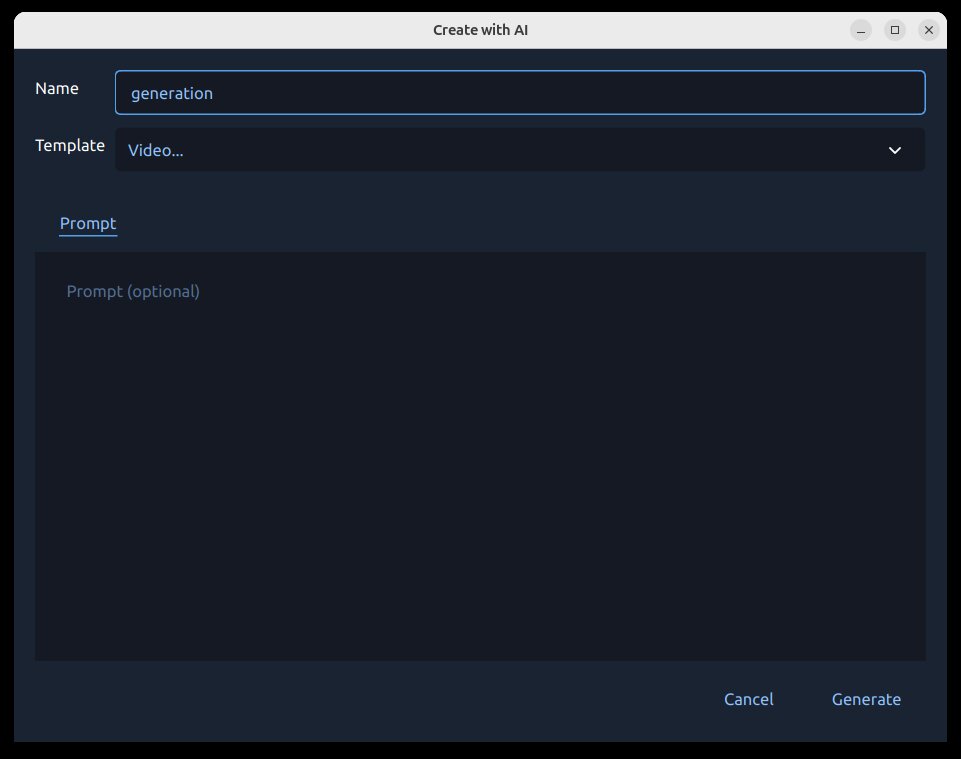

Diálogo de acción de IA

Tanto Crear con IA como Mejorar con IA abren el mismo diálogo de generación.

Por qué importa este diálogo:

Mantiene todas las entradas de IA en un solo lugar.

Valida los campos requeridos antes de poner el trabajo en cola.

Te permite configurar indicaciones de seguimiento antes de ejecuciones costosas.

Qué puedes hacer en el diálogo:

Elige el flujo de trabajo/acción.

Introduce el texto del prompt.

Previsualiza el archivo fuente seleccionado (para flujos de trabajo de mejora).

Establece el nombre de salida para los medios generados.

Seleccione una imagen de referencia en la pestaña Reference para los flujos de trabajo que la requieran.

Proporciona puntos/rectángulos de seguimiento para flujos de trabajo de seguimiento.

Inicia el trabajo con Generar o cierra con Cancelar.

Seguimiento (Máscara, Desenfoque, Resaltar)

Los flujos de trabajo de seguimiento (Desenfocar…, Resaltar…, Máscara…) usan una pantalla de región donde marcas qué incluir y qué ignorar.

Por qué esto importa

El seguimiento ayuda a que tu efecto permanezca adherido a un sujeto en movimiento a lo largo del tiempo. Por ejemplo, puedes desenfocar un rostro, resaltar a un jugador o generar una máscara limpia que siga el mismo objeto a través de muchos fotogramas.

Iconos de seguimiento

Icono / Marcador |

Significado |

|---|---|

Punto azul |

Coordenada de seguimiento positiva (punto semilla de primer plano/sujeto). |

Punto rojo |

Coordenada de seguimiento negativa (punto semilla de fondo/exclusión). |

Rectángulo azul |

Semilla de región positiva (indicio amplio del sujeto). |

Rectángulo rojo |

Semilla de región negativa (indicio amplio de exclusión). |

Icono de eliminar |

Borra todas las semillas de seguimiento actuales (puntos/rectángulos) y comienza de nuevo. |

Cómo funciona el seguimiento

OpenShot envía tus marcadores positivos y negativos como coordenadas semilla al modelo de seguimiento, que construye una máscara para el sujeto y luego lo sigue a lo largo del tiempo. Semillas mejores suelen producir máscaras más limpias y menos deriva. [sam2]

Cómo usarlo

Elige un fotograma donde el sujeto sea claramente visible.

Comienza con un punto azul en el sujeto.

Añade puntos rojos en el fondo cercano solo si es necesario.

Añade rectángulos cuando necesites una selección amplia más rápida.

Repite en fotogramas adicionales cuando cambie el movimiento o la forma.

Ajustando a lo largo del tiempo (deslizador de fotogramas):

Mueve el deslizador de fotogramas a diferentes momentos del clip.

Añade o ajusta puntos/rectángulos en fotogramas donde el seguimiento comienza a desviarse.

Usa puntos semilla adicionales solo donde sea necesario, especialmente en oclusiones, movimientos rápidos o cambios importantes de forma.

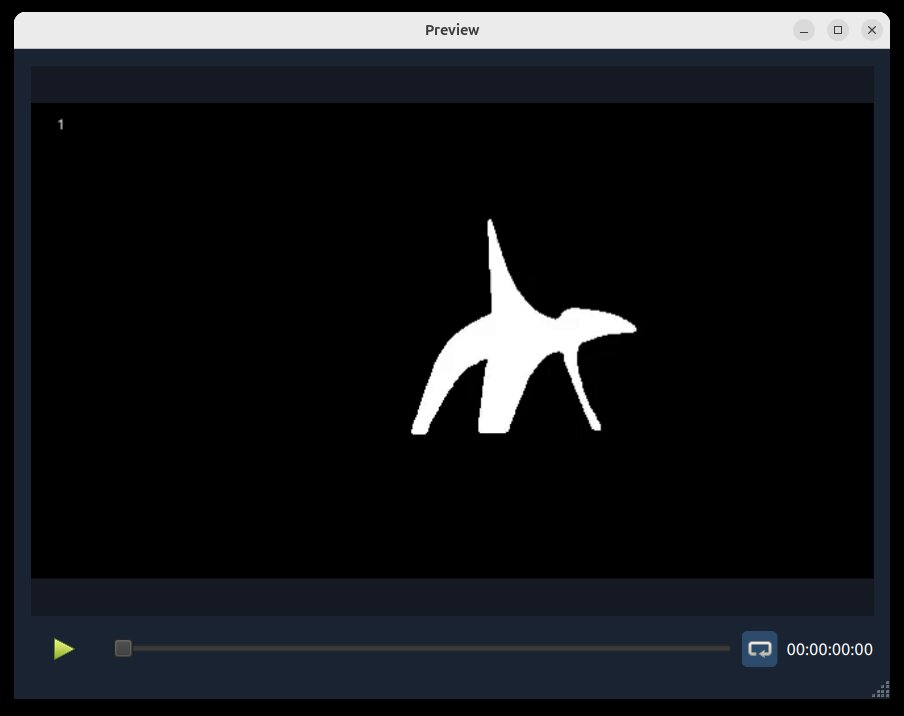

Salida de vista previa de máscara (de este proceso de seguimiento):

Mejores prácticas

Usa primero un clip de prueba corto.

Comienza simple: un solo punto azul suele ser suficiente.

Añade más puntos solo donde el seguimiento falle.

Si es necesario, agregue un conjunto más matizado de puntos y rectángulos positivos/negativos.

Mantenga los puntos positivos y negativos claramente separados.

Si el seguimiento se vuelve desordenado, use el ícono de eliminar y reinicie con semillas más limpias.

Proyecto SAM2 (Segment Anything Model 2): facebookresearch/sam2

Cola de trabajos, progreso y cancelar

Después de hacer clic en Generar, la solicitud se pone en cola y se ejecuta en la cola de trabajos de IA de OpenShot.

El progreso se muestra en Archivos del proyecto (insignias y texto de estado).

Las salidas completadas se importan de nuevo en Archivos del proyecto.

Los trabajos activos se pueden cancelar haciendo clic derecho en el archivo del proyecto generado con la barra de progreso y eligiendo Cancelar Trabajo.

Las salidas se guardan en

.openshot_qt/comfyui-output/.

Flujos de trabajo JSON integrados

Las secciones siguientes se asignan directamente a las plantillas JSON integradas en comfyui/. Cada subsección describe por qué podría usarlo, cómo ejecutarlo y detalles clave.

Crear con IA

Imagen… (txt2img-basic)

Por qué: Generar imágenes fijas a partir de un texto.

Cómo: Elija Crear con IA -> Imagen…, ingrese un texto y luego genere.

Detalles: utiliza

comfyui/txt2img-basic.jsonconsd_xl_base_1.0.safetensors.

Video… (txt2video-svd)

Por qué: Generar clips de video cortos a partir de texto.

Cómo: Elija Crear con IA -> Video…, ingrese un texto y luego genere.

Detalles: Utiliza

comfyui/txt2video-svd.jsoncon modelos de generación de video WAN.

Sonido… (txt2audio-stable-open)

Por qué: Generar audio no musical a partir de textos.

Cómo: Elija Crear con IA -> Sonido…, ingrese un texto y luego genere.

Detalles: Utiliza

comfyui/txt2audio-stable-open.jsoncon modelos Stable Audio Open.

Música… (txt2music-ace-step)

Por qué: Generar música a partir de estilo/etiquetas (y letras opcionales).

Cómo: Elija Crear con IA -> Música…, ingrese el texto y luego genere.

Detalles: Utiliza

comfyui/txt2music-ace-step.jsoncon un punto de control Ace-Step 1.5.

Mejorar con IA

Cambiar estilo de imagen… (img2img-basic)

Por qué: Cambiar el estilo de una imagen existente manteniendo la composición original.

Cómo: Elija Mejorar con IA en una imagen, ingrese un texto de estilo y luego genere.

Detalles: utiliza

comfyui/img2img-basic.jsonconsd_xl_base_1.0.safetensors.

Profundidad (image-extract-depth)

Por qué: Exportar una imagen de mapa de profundidad en escala de grises desde una imagen fuente.

Cómo: Elija Enhance with AI -> Extract -> Depth en una imagen, luego genere.

Detalles: Usa

comfyui/image-extract-depth.jsonconDepthAnythingV2Preprocessor.

Líneas (image-extract-lines)

Por qué: Exportar una imagen de mapa de líneas desde una imagen fuente.

Cómo: Elija Enhance with AI -> Extract -> Lines en una imagen, luego genere.

Detalles: Usa

comfyui/image-extract-lines.jsonconLineArtPreprocessor.

Imagen a video… (img2video-wan)

Por qué: Convertir una imagen fija en un video generado.

Cómo: Elija Mejorar con IA en una imagen, proporcione indicaciones y luego genere.

Detalles: Usa

comfyui/img2video-wan.jsoncon modelos WAN 2.2 de imagen a video.

Cambiar estilo de video… (video2video-basic)

Por qué: Aplicar un nuevo estilo visual a un video fuente.

Cómo: Elija Enhance with AI en un video, ingrese un prompt de estilo, seleccione una imagen de referencia en la pestaña Reference, luego genere.

Detalles: Usa

comfyui/video2video-basic.jsoncon nodos WAN VACE de video a video, una imagen de referencia requerida, profundidad combinada deDepthAnythingV2Preprocessormás control de bordes Canny, y los modeloswan2.1_vace_1.3B_fp16.safetensors,wan_2.1_vae.safetensorsyumt5_xxl_fp8_e4m3fn_scaled.safetensors.

Profundidad (video-extract-depth)

Por qué: Exportar una versión en mapa de profundidad en escala de grises de un video fuente.

Cómo: Elija Enhance with AI -> Extract -> Depth en un video, luego genere.

Detalles: Usa

comfyui/video-extract-depth.jsonconDepthAnythingV2Preprocessory preserva la tasa de cuadros original.

Líneas (video-extract-lines)

Por qué: Exportar una versión en mapa de líneas de un video fuente.

Cómo: Elija Enhance with AI -> Extract -> Lines en un video, luego genere.

Detalles: Usa

comfyui/video-extract-lines.jsonconLineArtPreprocessory preserva la tasa de cuadros original.

Aumentar resolución (imagen) (upscale-realesrgan-x4)

Por qué: Mejorar imágenes de baja resolución.

Cómo: Elija Mejorar con IA en una imagen, seleccione aumentar resolución y luego genere.

Detalles: utiliza

comfyui/upscale-realesrgan-x4.jsonconRealESRGAN_x4plus.safetensors.

Aumentar resolución (video) (video-upscale-gan)

Por qué: Mejorar los fotogramas de video para mayor detalle aparente.

Cómo: Elija Mejorar con IA en un video, seleccione aumentar resolución y luego genere.

Detalles: utiliza

comfyui/video-upscale-gan.jsonconRealESRGAN_x4plus.safetensors.

Movimiento suave (doble tasa de fotogramas) (video-frame-interpolation-rife2x)

Por qué: Aumentar la tasa de fotogramas para un movimiento percibido más suave.

Cómo: Elija Mejorar con IA en un video, seleccione movimiento suave y luego genere.

Detalles: utiliza

comfyui/video-frame-interpolation-rife2x.jsonconrife47.pth.

Dividir en escenas (video-segment-scenes-transnet)

Por qué: Detectar automáticamente cambios de escena y dividir clips largos en segmentos.

Cómo: Elija Mejorar con IA en un video, seleccione división de escenas y luego genere.

Detalles: Utiliza

comfyui/video-segment-scenes-transnet.jsoncon TransNetV2.

Agregar subtítulos desde el habla (video-whisper-srt)

Por qué: Transcribir el habla en archivos de subtítulos/captions.

Cómo: Elija Mejorar con IA en un video, seleccione subtítulos y luego genere.

Detalles: utiliza

comfyui/video-whisper-srt.jsony crea salida SRT.

Flujos de trabajo de seguimiento (SAM2)

Estos flujos de trabajo usan el mismo flujo de entrada de región/seguimiento y están agrupados en el menú contextual de seguimiento.

Desenfocar… (imagen) (image-blur-anything-sam2)

Por qué: Desenfocar áreas seleccionadas del sujeto en una imagen fija.

Cómo: Seleccione puntos/rectángulos para el sujeto, luego genere.

Detalles: utiliza

comfyui/image-blur-anything-sam2.jsoncon segmentación de imágenes SAM2.

Resaltar… (imagen) (image-highlight-anything-sam2)

Por qué: Enfatizar áreas seleccionadas del sujeto en una imagen fija.

Cómo: Seleccione puntos/rectángulos para el sujeto, luego genere.

Detalles: utiliza

comfyui/image-highlight-anything-sam2.jsoncon segmentación de imágenes SAM2.

Máscara… (imagen) (image-mask-anything-sam2)

Por qué: Generar una máscara de imagen para áreas seleccionadas del sujeto.

Cómo: Seleccione puntos/rectángulos para el sujeto, luego genere.

Detalles: utiliza

comfyui/image-mask-anything-sam2.jsoncon segmentación de imágenes SAM2.

Desenfocar… (video) (video-blur-anything-sam2)

Por qué: Rastrear y desenfocar un sujeto en movimiento en video.

Cómo: Marque sujeto/fondo en la pantalla de región, luego genere.

Detalles: Utiliza

comfyui/video-blur-anything-sam2.jsoncon seguimiento de video SAM2.

Resaltar… (video) (video-highlight-anything-sam2)

Por qué: Rastrear y resaltar un sujeto en movimiento en video.

Cómo: Marque sujeto/fondo en la pantalla de región, luego genere.

Detalles: Utiliza

comfyui/video-highlight-anything-sam2.jsoncon seguimiento de video SAM2.

Máscara… (video) (video-mask-anything-sam2)

Por qué: Generar una máscara animada que sigue a un sujeto en movimiento.

Cómo: Marque sujeto/fondo en la pantalla de región, luego genere.

Detalles: Utiliza

comfyui/video-mask-anything-sam2.jsoncon seguimiento de video SAM2.

Puntos de partida para nuevos usuarios

Si eres nuevo en estas herramientas, comienza con:

Crear con IA -> Imagen

Mejorar con IA -> Aumentar resolución

Mejorar con IA -> Suavizar movimiento

Mejorar con IA -> Dividir en escenas

Mejorar con IA -> Agregar subtítulos

Solución de problemas

Si los menús de IA no aparecen o los trabajos fallan inmediatamente:

Verifique que ComfyUI esté en ejecución y accesible en la URL configurada.

Confirme que los modelos requeridos existen en su entorno ComfyUI.

Confirme que los paquetes de nodos personalizados están instalados para el flujo de trabajo que seleccionó.

Reduzca el tamaño de lotes/fragmentos para clips largos.

Vuelva a probar primero con un clip corto o una imagen fija.

Para el ajuste general de rendimiento y caché, consulte Preferencias y Reproducción.